���ѧϰAMI������Աָ��.pdf

http://www.100md.com

2020��2��6��

|

| ��1ҳ |

|

| ��7ҳ |

|

| ��19ҳ |

|

| ��28ҳ |

|

| ��31ҳ |

|

| ��85ҳ |

�μ�����(2002KB��242ҳ)��

���ѧϰAMI������Աָ�����Ȿ�����AMI����д���˴�����ѧϰ���ϣ�������Ϊ����Ŀ�����Ա������д�������ܵͲ��Ӧ�ã�Ҳд���˺ܶస���Ľ��ܣ���������õ�ѧϰ��

���ѧϰAMI������Աָ�Ͻ���

��ָ�Ͻ�������������ʹ�� DLAMI����������������ѵ���Ƶ������ѧϰ�ļ��ֳ���ʹ�ð�������ָ�ϻ�������������������;ѡ����ʵ� AMI ����ϲ����ʵ�����͡�DLAMI ���ÿ������ṩ����̡̳������ҵ������������ Jupyter ��������������н̵̳�˵����

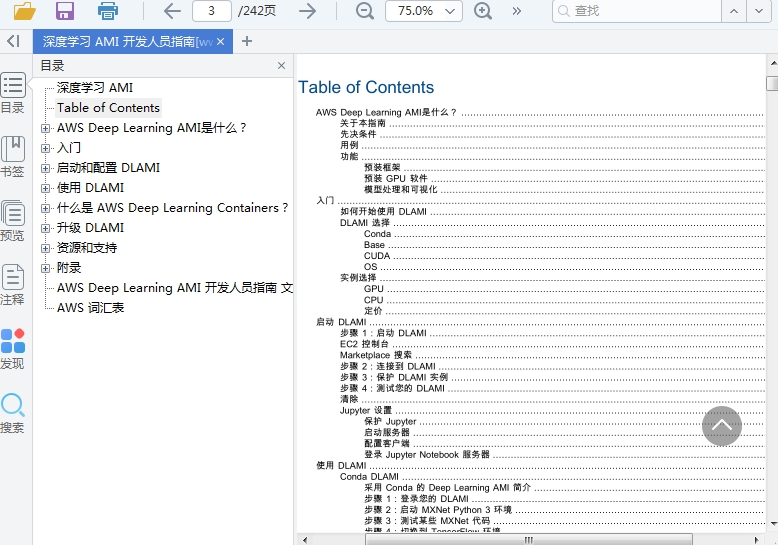

���ѧϰAMI������Աָ����Ŀ¼

���ѧϰAMI

Table of Contents

AWS Deep Learning AMI��ʲô��

����

���������� DLAMI

ʹ��DLAMI

ʲô��AWS Deep Learning Containers?

���� DLAMI

��Դ��֧��

����ʾ��DLAMI�÷�

�˽����ѧϰ��DLAMI ��ѧϰ����ڻ���ѧϰ�����ѧϰ��ܵ�����ѡ��������Ҫ��ÿ����ܵİ�װ���й����ų�������ͬһ̨����������п�ܡ�DLAMI ���� Jupyter Notebook���������ɵ�����Ϥ����ѧϰ�����ѧϰ�������п���ṩ�Ľ̡̳�

Ӧ�ó������������Ӧ�ó�����Ա����������Ȥʹ�����ѧϰ��ʹ����Ӧ�ó������� AI ��������½������� DLAMI ������IJ���ƽ̨��ÿ����ܶ������˹�����ο�ʼʹ�����ѧϰ�Ľ̳̣���������̶̳���ģ�Ͷ������������������������ѧϰ��������Ҫ�Լ���������������ģ��ѵ����һЩʾ������չʾ����ڼ������ڹ���ӳ����Ӧ�ó������Ϊ���Լ��������Զ���������ʶ��Ӧ�ó���

����ѧϰ�����ݷ���������������ݿ�ѧ�һ�����Ȥͨ�����ѧϰ�������ݣ����ᷢ�������ܶ�֧�� R ��Spark�������ҵ����ڽ��мع�Ľ̳̣��Լ�Ϊ���Ի���Ԥ��ϵͳ��������չ�����ݴ���ϵͳ�Ľ̡̳�

�о����������һ���о���Ա������ϣ�������¿�ܡ�������ģ�ͻ���ѵ��ģ�ͣ�DLAMI �� AWS ��չ���ܿ��Լ��ٰ�װ���������ѵ�ڵ�ķ���������������ʹ�� EMR �� AWS CloudFormation ģ����������������ʵ����Ⱥ��������ʱ�������ڿ���չ����ѵ��

���ѧϰAMI������Աָ�Ͻ�ͼ

���ѧϰ AMI

������Աָ�����ѧϰ AMI ������Աָ��

���ѧϰ AMI: ������Աָ�� Copyright ? 2019 Amazon Web Services, Inc. andor its affiliates. All rights reserved.

Amazon's trademarks and trade dress may not be used in connection with any product or service that is not Amazon's,in any manner that is likely to cause confusion among customers, or in any manner that disparages or discredits

Amazon. All other trademarks not owned by Amazon are the property of their respective owners, who may or may not

be affiliated with, connected to, or sponsored by Amazon.���ѧϰ AMI ������Աָ��

AWS Deep Learning AMI��ʲô�� ........................................................................................................ 1

���ڱ�ָ�� ................................................................................................................................ 1

�Ⱦ����� .................................................................................................................................... 1

���� .......................................................................................................................................... 1

���� .......................................................................................................................................... 1

Ԥװ��� ............................................................................................................................ 1

Ԥװ GPU ���� .................................................................................................................. 2

ģ�ʹ����Ϳ��ӻ� ............................................................................................................... 2

���� .................................................................................................................................................. 3

��ο�ʼʹ�� DLAMI ................................................................................................................... 3

DLAMI ѡ�� ............................................................................................................................... 3

Conda ............................................................................................................................... 3

Base ................................................................................................................................. 4

CUDA ............................................................................................................................... 5

OS ................................................................................................................................... 6

ʵ��ѡ�� .................................................................................................................................... 6

GPU ................................................................................................................................. 7

CPU ................................................................................................................................. 7

���� .................................................................................................................................. 7

���� DLAMI ....................................................................................................................................... 9

���� 1������ DLAMI ................................................................................................................... 9

EC2 ����̨ ............................................................................................................................... 9

Marketplace ���� ...................................................................................................................... 10

���� 2�����ӵ� DLAMI .............................................................................................................. 10

���� 3������ DLAMI ʵ�� .......................................................................................................... 11

���� 4���������� DLAMI ........................................................................................................... 11

��� ........................................................................................................................................ 11

Jupyter ���� ............................................................................................................................. 11

���� Jupyter ..................................................................................................................... 12

���������� ....................................................................................................................... 12

���ÿͻ��� ....................................................................................................................... 13

��¼ Jupyter Notebook ������ ............................................................................................ 14

ʹ�� DLAMI ..................................................................................................................................... 17

Conda DLAMI .......................................................................................................................... 17

���� Conda �� Deep Learning AMI ��� .............................................................................. 17

���� 1����¼���� DLAMI ................................................................................................... 17

���� 2������ MXNet Python 3 ���� ..................................................................................... 18

���� 3������ij٠MXNet ���� ............................................................................................ 19

���� 4����� TensorFlow ���� ........................................................................................ 19

ɾ������ .......................................................................................................................... 20

���� DLAMI ............................................................................................................................. 20

ʹ�� Deep Learning Base AMI ............................................................................................ 20

���� CUDA �汾 ............................................................................................................... 20

Jupyter �ʼDZ����� ................................................................................................................... 21

�����Ѱ�װ�Ľ̳� .............................................................................................................. 21

ͨ�� Jupyter �л����� ....................................................................................................... 22

�̳� ........................................................................................................................................ 22

10 ���ӽ̳� ..................................................................................................................... 22

������ .......................................................................................................................... 22

���ԺͿ��ӻ� .................................................................................................................... 33

�ֲ�ʽѵ�� ....................................................................................................................... 36

GPU ��غ��Ż� ............................................................................................................... 52

���� ................................................................................................................................ 57

��������� ONNX ............................................................................................................. 60

iii���ѧϰ AMI ������Աָ��

ģ�ʹ��� .......................................................................................................................... 68

Deep Learning Containers .................................................................................................................. 72

Amazon EC2 �ϵ�Deep Learning Containers ................................................................................ 72

���� ................................................................................................................................ 72

�̳� ................................................................................................................................ 73

ECS �ϵ� Deep Learning Containers ........................................................................................... 76

���� ................................................................................................................................ 77

�̳� ................................................................................................................................ 78

Amazon EKS �ϵ� Deep Learning Containers ............................................................................... 90

���� ................................................................................................................................ 91

�̳� ................................................................................................................................ 96

EKS �ϵ� AWS Deep Learning Containers�����ų� .............................................................. 118

EKS �ϵ� AWS Deep Learning Containers�ʻ�� ................................................................. 120

Amazon SageMaker �ϵ� Deep Learning Containers .................................................................... 121

��¼ ...................................................................................................................................... 122

Deep Learning Containersӳ�� .......................................................................................... 122

�Զ���ӳ�� ..................................................................................................................... 127

MKL ���� ....................................................................................................................... 128

���� DLAMI .................................................................................................................................... 132

DLAMI ���� ............................................................................................................................ 132

�������� ................................................................................................................................ 132

��Դ .............................................................................................................................................. 133

��̳ ...................................................................................................................................... 133

���� ...................................................................................................................................... 133

�������� ................................................................................................................................ 133

��¼ .............................................................................................................................................. 136

AMI ѡ�� ................................................................................................................................ 136

Conda ........................................................................................................................... 136

Base ............................................................................................................................. 137

CUDA 10 ....................................................................................................................... 138

CUDA 9 ......................................................................................................................... 138

CUDA 8 ......................................................................................................................... 139

Ubuntu ........................................................................................................................... 139

Amazon Linux ................................................................................................................. 140

Amazon Linux 2 .............................................................................................................. 141

Windows ........................................................................................................................ 141

DLAMI������˵�� .................................................................................................................... 142

�汾�浵 ........................................................................................................................ 142

�ĵ���ʷ��¼ .................................................................................................................................. 235

AWS �ʻ�� ................................................................................................................................... 238

iv���ѧϰ AMI ������Աָ��

���ڱ�ָ��

AWS Deep Learning AMI��ʲô��

��ӭ�Ķ� AWS Deep Learning AMI �û�ָ�ϡ�

AWS Deep Learning AMI (DLAMI) �������н������ѧϰ��һվʽ�̵ꡣ���Զ�������ʵ�������ڴ����

Amazon EC2 �����еĸ���ʵ�����ͣ��ӽ����� CPU ��С��ʵ�������µĸ����ܶ� GPU ʵ������Ԥ������

NVIDIA CUDA �� NVIDIA cuDNN �Լ���õ����ѧϰ��ܵ����°汾��

���ڱ�ָ��

��ָ�Ͻ�������������ʹ�� DLAMI����������������ѵ���Ƶ������ѧϰ�ļ��ֳ���ʹ�ð�������ָ�ϻ���

����������������;ѡ����ʵ� AMI ����ϲ����ʵ�����͡�DLAMI ���ÿ������ṩ����̡̳�������

������������� Jupyter ��������������н̵̳�˵����

�Ⱦ�����

��Ӧ����Ϥ�����й��ߺͻ��� Python ���ܳɹ����� DLAMI����������ṩ�й����ʹ��ÿ����ܵĽ̳̣����DZ�ָ�Ͽ�������չʾ��μ���ÿ����ܲ��ҵ��ʵ������Ž̡̳�

ʾ�� DLAMI �÷�

�˽����ѧϰ��DLAMI ��ѧϰ����ڻ���ѧϰ�����ѧϰ��ܵ�����ѡ��������Ҫ��ÿ����ܵİ�װ����

�����ų�������ͬһ̨����������п�ܡ�DLAMI ���� Jupyter Notebook���������ɵ�����Ϥ����ѧϰ��

���ѧϰ�������п���ṩ�Ľ̡̳�

Ӧ�ó������������Ӧ�ó�����Ա����������Ȥʹ�����ѧϰ��ʹ����Ӧ�ó������� AI ���������

�������� DLAMI ������IJ���ƽ̨��ÿ����ܶ������˹�����ο�ʼʹ�����ѧϰ�Ľ̳̣���������̶̳�

��ģ�Ͷ������������������������ѧϰ��������Ҫ�Լ���������������ģ��ѵ����һЩʾ������չ

ʾ����ڼ������ڹ���ӳ����Ӧ�ó������Ϊ���Լ��������Զ���������ʶ��Ӧ�ó���

����ѧϰ�����ݷ���������������ݿ�ѧ�һ�����Ȥͨ�����ѧϰ�������ݣ����ᷢ�������ܶ�֧�� R ��

Spark�������ҵ����ڽ��мع�Ľ̳̣��Լ�Ϊ���Ի���Ԥ��ϵͳ��������չ�����ݴ���ϵͳ�Ľ̡̳�

�о����������һ���о���Ա������ϣ�������¿�ܡ�������ģ�ͻ���ѵ��ģ�ͣ�DLAMI �� AWS ��չ����

���Լ��ٰ�װ���������ѵ�ڵ�ķ���������������ʹ�� EMR �� AWS CloudFormation ģ������������

����ʵ����Ⱥ��������ʱ�������ڿ���չ����ѵ��

Note

��Ȼ�������ѡ������ǽ�ʵ���������������ж�� GPU(��� 8 ��)�ĸ���ʵ��������Ҳ

����ͨ������ DLAMI ʵ����Ⱥ������ˮƽ��չ��Ҫ�������ü�Ⱥ��������ʹ��Ԥ����� AWS

CloudFormation ģ�塣�йؼ�Ⱥ�����ĸ�����Ϣ������� ��Դ��֧�� (p. 133)��

DLAMI ����

Ԥװ���

Ŀǰ��������Ҫ�� DLAMI�������������ϵͳ (OS) �������汾��ص��������壺

1���ѧϰ AMI ������Աָ��

Ԥװ GPU ����

���� Conda �� Deep Learning AMI (p. 3) - �ڵ����� Python ������ʹ�� conda �����������װ�Ŀ�

��

Deep Learning Base AMI (p. 4) - ����װ�κο�ܣ�ֻ�� NVIDIA CUDA ������������

�µ� ���� Conda �� Deep Learning AMI ʹ�� Anaconda ����������ÿ����ܣ���������������л���ܣ������õ��������������ͻ��

�й�ѡ����� DLAMI �ĸ�����Ϣ����鿴���� (p. 3)��

���� ���� Conda �� Deep Learning AMI ֧�ֵĿ�ܵ������б���

Apache MXNet

Caffe

Caffe2

CNTK

Keras

PyTorch

TensorFlow

Theano

Ԥװ GPU ����

��ʹ��ʹ�ý����� CPU ��ʵ����DLAMI Ҳ������ NVIDIA CUDA �� NVIDIA cuDNN������ʵ��������ʲ

ô����װ������������ͬ�ġ����ס��GPU �ض�����ֻ���������ٰ���һ�� GPU ��ʵ����ѡ�� DLAMI ��

ʵ������ (p. 6)�а����йش����ݵĸ�����Ϣ��

NVIDIA CUDA 9

NVIDIA cuDNN 7

CUDA 8 Ҳ���á��йظ�����Ϣ�������CUDA ��װ�Ϳ�ܰ� (p. 5)��

ģ�ʹ����Ϳ��ӻ�

���� Conda �� Deep Learning AMI Ԥװ������ģ�ͷ�������һ������ MXNet��һ������ TensorFlow����Ԥ

װ�� TensorBoard������ģ�Ϳ��ӻ���

������ Apache MXNet ��ģ�ͷ����� (MMS) (p. 68)

TensorFlow Serving (p. 69)

TensorBoard (p. 35)

2���ѧϰ AMI ������Աָ��

��ο�ʼʹ�� DLAMI

����

��ο�ʼʹ�� DLAMI

���źܼ���ָ�ϰ����˹���ѡ���ʺ����� DLAMI��ѡ���ʺ�����ʹ�ð�����Ԥ���ʵ�����͵ļ��ɣ���

�����������ܸ���Ȥ���Զ������õ���Դ��֧�� (p. 133)��

������տ�ʼʹ�� AWS �� Amazon EC2�����ȴ� ���� Conda �� Deep Learning AMI (p. 3) ��ʼ�����

����Ϥ Amazon EC2 ������ AWS ����(�� Amazon EMR��Amazon EFS �� Amazon S3)����������Ȥ��

����Щ������������Ҫ�ֲ�ʽ��ѵ���Ƶ�����Ŀ��������Դ��֧�� (p. 133)�в鿴�Ƿ��з�������ʹ�ð���

�ķ���

���ǽ������鿴ѡ�� DLAMI (p. 3)�����˽����ʺ�����Ӧ�ó����ʵ�����͡�

��һ��ѡ���Ǵ˿��ٽ̳̣����� AWS Deep Learning AMI (�� 10 ������)��

��һ��

ѡ�� DLAMI (p. 3)

ѡ�� DLAMI

�����ܻᷢ�� DLAMI �кܶ�ѡ����Ҳ�����ĸ�ѡ�����ʺ�����ʹ�ð����������ֿ�����������������

�������ἰ DLAMI ʱ��ͨ����ʵ������Χ��ij���������ͻ��ܵ�һ�� AMI�������ֱ�����������Щ����

�ͻ��ܣ�

Conda �� Base

CUDA 8��CUDA 9 �� CUDA 10

Amazon Linux��Ubuntu �� Windows

��ָ���е��������������ڽ�һ�������ṩ��Ϣ�ͽ�һ�������˽����顣

����

���� Conda �� Deep Learning AMI (p. 3)

Deep Learning Base AMI (p. 4)

CUDA ��װ�Ϳ�ܰ� (p. 5)

DLAMI ����ϵͳѡ�� (p. 6)

��������

���� Conda �� Deep Learning AMI (p. 3)

���� Conda �� Deep Learning AMI

Conda DLAMI ʹ�� Anaconda ���������Щ��������Ϊ������װ��ͬ�Ŀ�ܡ������������������л���

�ܡ�����˽������ DLAMI �����ṩ�����п�ܺ��кô���������û��ᷢ���µ� ���� Conda �� Deep

Learning AMI �dz��ʺ����ǡ�

3���ѧϰ AMI ������Աָ��

Base

��Щ��Conda��AMI ������Ҫ�� DLAMI����������ʹ�ÿ���е����°汾���и��£���ӵ�����µ� GPU ����

������������ڴ�����ĵ��У���ͨ������Ϊ AWS Deep Learning AMI��

Ubuntu �� Amazon Linux DLAMI �������¿�ܣ�Apache

MXNet��Caffe��Caffe2��Chainer��CNTK��Keras��PyTorch��TensorFlow �� Theano

Amazon Linux 2 DLAMI �������¿�ܣ�Apache MXNet��Chainer��PyTorch��TensorFlow �� Keras

�ȶ��汾���ѡ�汾

Conda AMI ʹ��ÿ�������������ʽ�汾���Ż��������ļ��������к�ѡ�汾��ʵ���Թ��ܡ��Ż�ȡ��

�ڿ�ܶ� Intel �� MKL DNN �ȼ��ټ�����֧�֣���Щ�����ɼӿ��� C5��C4 �� C3 CPU ʵ�������ϵ�ѵ

���������ٶȡ��������ļ�Ҳ����������֧�ָ� Intel ָ��������������� AVX��AVX-2��SSE4.1 ��

SSE4.2����Щָ��ӿ� Intel CPU �ܹ�����������������ٶȡ����⣬���� GPU ʵ�����ͣ���ʹ����

�¹ٷ��汾֧�ֵ��κΰ汾���� CUDA �� cuDNN��

���� Conda �� Deep Learning AMI ���ڿ���״μ���ʱ�Զ�Ϊ���� EC2 ʵ����װ��ܵ����Ż��汾���й�

������Ϣ������� ʹ�� ���� Conda �� Deep Learning AMI (p. 17)��

���Ҫʹ���Զ�����Ż��İ汾ѡ���Դ��װ��Deep Learning Base AMI (p. 4) �����Ǹ��õ�ѡ��

CUDA ֧��

���� Conda �� Deep Learning AMI �� CUDA �汾�Լ�ÿ����֧�ֵĿ�ܣ�

ʹ�� cuDNN 7 �� CUDA 10��PyTorch��TensorFlow

ʹ�� cuDNN 7 �� CUDA 9��Apache MXNet��Caffe2��Chainer��CNTK��Keras��Theano

ʹ�� cuDNN 6 �� CUDA 8��Caffe

������ DLAMI������˵�� (p. 142)���ҵ��ض��Ŀ�ܰ汾��

ѡ����� DLAMI ���ͣ���ͨ�����������衱ѡ���˽��й����� DLAMI �ĸ�����Ϣ��

���� Conda �� Deep Learning AMI ѡ�� (p. 136)

��������

Deep Learning Base AMI (p. 4)

�������

�й�ʹ�ò��� Conda �� Deep Learning AMI �Ľ̳̣������ʹ�� ���� Conda �� Deep Learning

AMI (p. 17)�̡̳�

Deep Learning Base AMI

Deep Learning Base AMI ������һ���������ѧϰ�Ŀհ���������������Ҫ��һ�У�ֱ����װ�ض��Ŀ�

�ܡ�����ӵ����ѡ��� CUDA �汾��

Ϊʲôѡ�� Base DLAMI

�� AMI �ŶӶ�����Щ��Ҫ�������ѧϰ��Ŀ�ͽ������°汾����Ŀ�����߷dz����á���������Щϣ���Ƴ���

�������������İ�װ��ʹ������ NVIDIA ��������Ա���Ӷ����ǿ���רע��ѡ��Ҫ��װ�Ŀ�ܺͰ汾��

ѡ����� DLAMI ���ͣ���ͨ�����������衱ѡ���˽��й����� DLAMI �ĸ�����Ϣ��

4���ѧϰ AMI ������Աָ��

CUDA

Deep Learning Base AMI ѡ�� (p. 137)

��������

CUDA ��װ�Ϳ�ܰ� (p. 5)

�������

ʹ�� Deep Learning Base AMI (p. 20)

CUDA ��װ�Ϳ�ܰ�

���ѧϰ���dz�һ������ÿ����ܶ��ṩ���ȶ����汾����Щ�ȶ��汾���ܲ����������µ� CUDA �� cuDNN

ʵʩ���ܡ���������ô���� ������ȡ��������ʹ�ð���������Ҫ�Ĺ��ܡ��������ȷ������ʹ�����µ�

���� Conda �� Deep Learning AMI.���������п�ܵĹٷ� PIP �������ļ� ( ���� CUDA 8��CUDA 9 ��

CUDA 10)��ʹ��ÿ����ܶ�֧�ֵ��κ����°汾���������Ҫ���°汾����Ҫ�Զ������ѧϰ��������ʹ��

Deep Learning Base AMI��

�����һ��ָ�������� �ȶ��汾���ѡ�汾 (p. 4) �ϲ鿴���ǵ�ָ�ϡ�

ѡ����� CUDA �� DLAMI

Deep Learning Base AMI (p. 4) ���� CUDA 8��9 �� 10��

���� Conda �� Deep Learning AMI (p. 3) ���� CUDA 8��9 �� 10��

ʹ�� cuDNN 7 �� CUDA 10��PyTorch

ʹ�� cuDNN 7 �� CUDA 9��Apache MXNet��Caffe2��Chainer��CNTK��Keras��TensorFlow��Theano

ʹ�� cuDNN 6 �� CUDA 8��Caffe

�й� DLAMI ���ͺͲ���ϵͳ�İ�װѡ������ÿ�� CUDA �汾�� ѡ��ҳ�棺

���� CUDA 10 �� Deep Learning AMI ѡ�� (p. 138)

���� CUDA 9 �� Deep Learning AMI ѡ�� (p. 138)

���� CUDA 8 �� Deep Learning AMI ѡ�� (p. 139)

���� Conda �� Deep Learning AMI ѡ�� (p. 136)

Deep Learning Base AMI ѡ�� (p. 137)

������ DLAMI������˵�� (p. 142)���ҵ��ض��Ŀ�ܰ汾��

ѡ����� DLAMI ���ͣ���ͨ�����������衱ѡ���˽��й����� DLAMI �ĸ�����Ϣ��

ѡ��һ�� CUDA �汾���ڸ�¼�в鿴���иð汾������ DLAMI �б�������ʹ�á��������衱ѡ���˽ⲻͬ

DLAMI �ĸ�����Ϣ��

��������

DLAMI ����ϵͳѡ�� (p. 6)

�������

�й��� CUDA �汾֮���л���˵���������ʹ�� Deep Learning Base AMI (p. 20)�̡̳�

5���ѧϰ AMI ������Աָ��

OS

DLAMI ����ϵͳѡ��

DLAMI ��������г��IJ���ϵͳ�ṩ�����������Ϥ CentOS �� RedHat������������Ӧ AWS Deep

Learning AMI Amazon Linux ѡ�� (p. 140) �� AWS Deep Learning AMI Amazon Linux 2 ѡ�� (p. 141)��

���������ܸ�ϲ�� AWS Deep Learning AMI��Ubuntu ѡ�� (p. 139)��

�������Ҫ Windows ����ϵͳ�����ڴ˴��ҵ�����ѡ�AWS Deep Learning AMI��Windows ѡ

�� (p. 141)��

ѡ������һ������ϵͳ���ڸ�¼�в鿴�����б���������������裬ѡ������ AMI ��ʵ�����͡�

AWS Deep Learning AMI Amazon Linux ѡ�� (p. 140)

AWS Deep Learning AMI Amazon Linux 2 ѡ�� (p. 141)

AWS Deep Learning AMI��Ubuntu ѡ�� (p. 139)

AWS Deep Learning AMI��Windows ѡ�� (p. 141)

�����Ÿ��������������м������� DLAMI ��ѡ���������Ӧ�����������ʵ�����͡�����Ӧ��ȷ��������

ʹ�õ� AWS ����

��������

ѡ�� DLAMI ��ʵ������ (p. 6)

ѡ�� DLAMI ��ʵ������

ѡ��ʵ�����Ϳ�������һ����ս���������ǿ���ͨ�������������ѡ�����ʵ����ָ������������̸���

�ס����ס��DLAMI ����ѵģ����ײ�ļ�����Դ�����ǡ�

���������Ϥ���ѧϰ����ô��������Ҫһ�����е�һ GPU �ġ����ż���ʵ����

�����ע��Ԥ�㣬��ô������Ҫ������Сһ���ʵ����������ֻ�� CPU ��ʵ����

���������Ȥ����ѵ��ģ��������������Ԥ��(������ѵ��)������������Ҫ���� Amazon Elastic

Inference���⽫ʹ���ܹ�����һ���� GPU����ˣ������Ծ��õؽ�����չ�����ڴ����������������ܻ�

���־��д����ڴ�� CPU ʵ��(��������Щʵ���ļ�Ⱥ)�Ǹ��ѵĽ��������

���������Ȥѵ�������������ݵ�ģ�ͣ���ô��������Ҫ�����ʵ���������� GPU ʵ����Ⱥ��

DLAMI ������ÿ�������ã������Խ� DLAMI ���Ƶ���ѡ��������йظ�����Ϣ������� ���� AMI��

ÿ������֧�ֲ�ͬ��Χ��ʵ�����ͣ����Ҳ�ͬ�����ʵ�����ͳɱ�ͨ�����в�ͬ����ÿ�� DLAMI ��ҳ���ϣ���������һ��ʵ���ɱ��б�����ע������ѡ���б�����ȷ����ѡ��һ�������������Ŀͻ��������������

��ʹ�ö�� DLAMI �ҿ��ܴ���һ����Ⱥ����ȷ��Ϊ��Ⱥ�е����нڵ�ʹ����ͬ������

�й�ʵ��������ϸ��Ϣ����鿴 EC2 ʵ�����͡�

�й�����ĸ�����Ϣ������� EC2 ����

��ˣ��ڿ��ǵ�������ЩҪ��������������������ʹ�ð�����Ԥ���ʵ�����͡���ָ���е�����������

���ڽ�һ�������ṩ��Ϣ�ͽ�һ�������˽����顣

Important

Deep Learning AMI ������ NVIDIA Corporation ������ӵ�л��ṩ���������������߰�����

ͬ����ڰ��� NVIDIA Ӳ���� Amazon EC2 ʵ����ʹ����Щ NVIDIA �������������߰���

����

�Ƽ��� GPU ʵ�� (p. 7)

6���ѧϰ AMI ������Աָ��

GPU

�Ƽ��� CPU ʵ�� (p. 7)

DLAMI �Ķ��� (p. 7)

��������

�Ƽ��� GPU ʵ�� (p. 7)

�Ƽ��� GPU ʵ��

GPU ʵ�����Ƽ���������ȵ�ѧϰĿ�ġ��� GPU ʵ����ѵ����ģ�ͱ� CPU ʵ�����졣���������ж��

GPU ʵ��������������Է�ʽ�������ţ�Ҳ�����ھ��� GPU �Ķ��ʵ����ʹ�÷ֲ�ʽѵ����

Amazon EC2 P3 ʵ�� ������ 8 �� NVIDIA Tesla V100 GPU��

Amazon EC2 P2 ʵ�� ������ 16 �� NVIDIA NVIDIA K80 GPU��

Amazon EC2 G3 ʵ�� ������ 4 �� NVIDIA Tesla M60 GPU��

�鿴 EC2 ʵ������ ��ѡ���ټ��㡱���鿴��ͬ�� GPU ʵ��ѡ�

��������

�Ƽ��� CPU ʵ�� (p. 7)

�Ƽ��� CPU ʵ��

���������ڹ�עԤ�㣬�˽����ѧϰ������ֻ��������һ��Ԥ��������� CPU ����ж������ྭ��ʵ��

��ѡ�ijЩ��������� Intel �� MKL DNN���⽫�ӿ� C5 (���������������ж�����)��C4 �� C3 CPU ʵ��

�����ϵ�ѵ���������ٶȡ��������ӿ� GPU ʵ�������ϵ�������

Amazon EC2 C5 ʵ�������� 72 �� Intel vCPU��

Amazon EC2 C4 ʵ��ӵ�ж�� 36 �� Intel vCPU��

�鿴 EC2 ʵ�����Ͳ����Ҽ����Ż����鿴���� CPU ʵ��ѡ�

Note

C5 ʵ�� (��δ�����������ṩ) �ڿ�ѧ��ģ�����������ֲ�ʽ�����������ܼ��� (HPC) �ͻ������

ѧϰ����������ֳ�ɫ��

Important

������ƻ�ʹ�� Caffe����Ӧ��Ϊѡ��һ�� GPU ʵ������ DLAMI �ϣ�Caffe �������� GPU ֧�֣����� CPU ģʽ�����С�

��������

DLAMI �Ķ��� (p. 7)

DLAMI �Ķ���

DLAMI ����ѵģ����ǣ�����Ȼ��Ҫ�е� Amazon EC2 ������ AWS ����ɱ������������ѧϰ��������

�ģ�ÿ�������Լ��Ŀ�Դ����֤��NVIDIA �� GPU ��������ѵģ�Ҳ���Լ�������֤��

Ϊ��˵������ѣ�Ҳ������أ� ʲô�ǡ�Amazon EC2 ������ AWS ����ɱ�����

����һ�����������⡣Amazon EC2 �ϵ�һЩʵ�����ͱ����Ϊ��ѡ���Щʵ��ͨ����С�����Կ�������Щ

��ѵ�ʵ�������� DLAMI������ζ�ŵ���ֻʹ�ø�ʵ��������ʱ��������ȫ��ѵġ��������Ҫһ�����ܸ�

7���ѧϰ AMI ������Աָ��

����

ǿ���и��� CPU ���ġ�������̿ռ䡢���� RAM ��һ������ GPU ��ʵ������ô��Щʵ���ܿ��ܲ�

������ײ�ʵ�����С�����ζ�ţ�������Ҫ֧����Щ�ɱ���һ���뷨��������Ȼ����ѵģ�����������Ϊ��

ʹ�õĵײ�Ӳ�����ѡ�

����ѡ�� DLAMI ��ʵ������ (p. 6)�˽������ڿ�ѡ���ʵ����С�������Ϣ���Լ�ÿ�����͵�ʵ����

��Ԥ����ɵ����顣

��һ��

���������� DLAMI (p. 9)

8���ѧϰ AMI ������Աָ��

���� 1������ DLAMI

���������� DLAMI

������������Ӧ���Ѿ�������Ҫ�����ĸ� AMI ���뷨�����û�У���ʹ�ô��������� (p. 3)���ҵ���

AMI ѡ��ָ��ѡ��һ�� DLAMI����ʹ�ø�¼���� AMI ѡ�� (p. 136)�е����� AMI �б���

����Ӧ��֪����Ҫѡ���ĸ�ʵ�����ͺ������������ѡ�� DLAMI ��ʵ������ (p. 6)��

Note

���ǽ���ʾ����ʹ�� p2.xlarge ��ΪĬ��ʵ�����͡�ֻ�轫���滻Ϊ�����е��κ�ʵ�����͡�

Important

������ƻ�ʹ�� Elastic Inference�������������� DLAMI ֮ǰ��� Elastic Inference ���á�

����

���� 1������ DLAMI (p. 9)

EC2 ����̨ (p. 9)

Marketplace ���� (p. 10)

���� 2�����ӵ� DLAMI (p. 10)

���� 3������ DLAMI ʵ�� (p. 11)

���� 4���������� DLAMI (p. 11)

��� (p. 11)

���� Jupyter Notebook ������ (p. 11)

���� 1������ DLAMI

Note

�ڱ������У����ǿ��ܻ���� Deep Learning AMI (Ubuntu) �������á���ʹ��ѡ������ DLAMI����

ҲӦ�ܰ��ձ�ָ�Ͻ��в�����

����ʵ��

1. ������ͨ�����ַ�ʽ���� DLAMI����ѡ��һ�֣�

EC2 ����̨ (p. 9)

Marketplace ���� (p. 10)

Tip

CLI ѡ������ѡ��ʹ�� AWS CLI ���� DLAMI��������Ҫ AMI �� ID�������ʵ�����͡���

�����İ�ȫ������Ϣ����ȷ������ӵ�� AMI ��ʵ�� ID���������δ���� AWS CLI�������Ȱ�

�հ�װ AWS �����нӿ�ָ�Ͻ������á�

2. ������Ѿ����������ij��ѡ��IJ��裬��ȴ�ʵ�����á���ͨ������Ҫ������ʱ�䡣�������� EC2

����̨����֤ʵ����״̬��

EC2 ����̨

1. �� EC2 ����̨.

2. ��ע�����ĵ����еĵ�ǰ��������ⲻ��������� AWS ��������Ĵ�ѡ�Ȼ���ټ�������

�ظ�����Ϣ������� EC2 ����

9���ѧϰ AMI ������Աָ��

Marketplace ����

3. ѡ�� Launch Instance��

4. �����������������ʵ����

1. ѡ�� AWS Marketplace����...

2. ѡ�� QuickStart�� �˴�ֻ���г�һ���ֿ��õ� DLAMI��

3. ���� Deep Learning AMI��ֻ���������ͣ���������IJ���ϵͳ���������Conda��Դ�ȡ�

4. �����Щѡ�����ѡ��ʱ���� Select��

5. �����ϸ��Ϣ��Ȼ��ѡ�� Continue��

6. ѡ��һ��ʵ�����͡�

Note

�����Ҫʹ�� Elastic Inference (EI)���뵥�� Configure Instance Details (����ʵ����ϸ��Ϣ)��ѡ�� Add an Amazon EI accelerator (���� Amazon EI ������)��Ȼ��ѡ�� Amazon EI ��������

����

7. ѡ�� Review and Launch��

8. �����ϸ��Ϣ�Ͷ��ۡ�ѡ�� Launch��

Tip

�鿴 ��ʼʹ�� AWS Deep Learning AMI �������ѧϰ�������а�����Ļ��ͼ������!

��һ��

���� 2�����ӵ� DLAMI (p. 10)

Marketplace ����

1. ��� AWS Marketplace ������ AWS Deep Learning AMI��

2. �����Щѡ�����ѡ��ʱ���� Select��

3. �����ϸ��Ϣ��Ȼ��ѡ�� Continue��

4. �����ϸ��Ϣ������¼ Region������ⲻ��������� AWS ��������Ĵ�ѡ�Ȼ���ټ������йظ�

����Ϣ������� EC2 ����

5. ѡ��һ��ʵ�����͡�

6. ѡ��һ����Կ�ԣ�����ʹ������Ĭ����Կ�ԣ�Ҳ���Դ�������Կ�ԡ�

7. �����ϸ��Ϣ�Ͷ��ۡ�

8. ѡ�� Launch with 1-Click��

��һ��

���� 2�����ӵ� DLAMI (p. 10)

���� 2�����ӵ� DLAMI

�ӿͻ���(Windows��MacOS �� Linux)���ӵ��������� DLAMI���йظ�����Ϣ������� Amazon EC2 ��

��ָ��(������ Linux ʵ��) �е����ӵ����� Linux ʵ����

����ڵ�¼����ϣ��ִ�� Jupyter ���ã������ֱ߱���һ�� SSH ��¼�������ʹ���������ĸ��ֱ�����

�ӵ� Jupyter ��ҳ��

��һ��

10���ѧϰ AMI ������Աָ��

���� 3������ DLAMI ʵ��

���� 3������ DLAMI ʵ�� (p. 11)

���� 3������ DLAMI ʵ��

һ��������������Ƴ�������Ӧ�ã��Ӷ�ʼ�ձ��ֲ���ϵͳ�������Ѱ�װ����Ϊ���¡�

�����ʹ�õ��� Amazon Linux �� Ubuntu��������¼���� DLAMI ʱ������յ�����֪ͨ(�����)����

�ῴ������˵�����й� Amazon Linux ά���ĸ�����Ϣ������ĸ���ʵ������������ Ubuntu ʵ���������

�ٷ� Ubuntu �ĵ���

�� Windows �ϣ����ڼ�� Windows Update ���������Ͱ�ȫ���¡������Ը�⣬�����Զ�Ӧ�ø��¡�

Important

�й� Meltdown �� Spectre ©���Լ����������ϵͳ�������Щ�������Ϣ������İ�ȫ����

AWS-2018-013��

���� 4���������� DLAMI

�������� DLAMI �汾��ͬ�����IJ���ѡ��Ҳ�ͬ��

���� Conda �� Deep Learning AMI (p. 3) �C ת�� ʹ�� ���� Conda �� Deep Learning AMI (p. 17)��

Deep Learning Base AMI (p. 4) �C ���������ܵİ�װ�ĵ���

�������Դ��� Jupyter �ʼDZ����ԣ����ý̳̣���ʼʹ�� Python ���롣�йظ�����Ϣ�����������

Jupyter Notebook ������ (p. 11)��

���

����������Ҫ DLAMI ʱ�������Խ���ֹͣ����ֹ���Ա�����������ķ��á�ֹͣ��ʵ���ᱣ�����Ա�������

�Ժ��ټ������������á��ļ�����������ʧ����Ϣ���洢�� Amazon S3 �ϵľ��С���ʵ��ֹͣ������£�����ȡ��С�� S3 �����������þ������ڼ�����Դ����ֹͣ״̬ʱ�����ٶ�����ȡ���á�������������ʵ��

ʱ���������ظþ������������ݻ����»ָ����������ֹʵ����������ʧ��������������������������

����ʵ����פ���� S3 �У���ˣ�Ϊ�˷�ֹ�κν�һ���ķ��ã�������Ҫɾ���þ����йظ���˵���������

Amazon EC2 �û�ָ��(������ Linux ʵ��) �е� ��ֹ����ʵ����

���� Jupyter Notebook ������

Jupyter Notebook ��һ�� Web Ӧ�ó���������ʹ�� Web ����������ʼDZ��ĵ���

Ҫ���� Jupyter Notebook������Ҫ������²�����

������ Amazon EC2 ʵ�������� Jupyter Notebook ��������

�������Ŀͻ��ˣ��Ա����������ӵ� Jupyter Notebook �������������ṩ������ Windows��macOS ��

Linux �ͻ��˵�����˵����

��¼ Jupyter Notebook ���������������á�

�й� Jupyter Notebook �ĸ�����Ϣ������� Jupyter��

����

�������� Jupyter ������ (p. 12)

11���ѧϰ AMI ������Աָ��

���� Jupyter

���� Jupyter Notebook ������ (p. 12)

���ÿͻ��������ӵ� Jupyter ������ (p. 13)

��¼ Jupyter Notebook ���������в��� (p. 14)

�������� Jupyter ������

��������ʹ�� SSL ���Զ������������� Jupyter��

���ӵ� Amazon EC2 ʵ����Ȼ��������²��衣

���� Jupyter ������

1. Jupyter �ṩ��һ������ʵ�ù��ߡ��������������������ʾ��������������ѡ���롣

jupyter notebook password

����������£�

Enter password:

Verify password:

[NotebookPasswordApp] Wrote hashed password to homeubuntu.jupyter

jupyter_notebook_config.json

2. ������ǩ�� SSL ֤�顣������ʾ��д����Ϊ�ʵ����������Ĵ𰸽�����Ӱ��֤��Ĺ����ԡ�

cd ~

mkdir ssl

cd ssl

openssl req -x509 -nodes -days 365 -newkey rsa:2048 -keyout mykey.key -out mycert.pem

Note

������ϣ������һ������� SSL ֤�飬��֤��Ϊ������ǩ�����Ҳ��ᵼ�����������������ȫ��

�档�˹����漰���ݽ϶ࡣ���� Jupyter ���ĵ����˽������Ϣ��

��һ��

���� Jupyter Notebook ������ (p. 12)

���� Jupyter Notebook ������

���ڣ�������ͨ����¼ʵ����Ȼ�������������������� Jupyter �������������ʹ��������һ���д�����

SSL ֤�顣

jupyter notebook --certfile=~sslmycert.pem --keyfile ~sslmykey.key

��������������ͨ�� SSH ���������Ŀͻ��˼�������ӵ���������������������ʱ��������������

Jupyter ��һЩ�������Щ���֤ʵ�������������С���ʱ������Գ�������ͨ���������� URL ���ʷ�����

�ı�ע����Ϊ����ʵ�����ԣ�ֱ��������������Ϊֹ��

Note

����ʹ�� Jupyter Web �����л����ʱ��Jupyter �������л������������й���Ϣ����ͨ�� Jupyter

����� (p. 22)��

��һ��

12���ѧϰ AMI ������Աָ��

���ÿͻ���

���ÿͻ��������ӵ� Jupyter ������ (p. 13)

���ÿͻ��������ӵ� Jupyter ������

�������Ŀͻ������ӵ� Jupyter Notebook �������������������Ĺ������еķ������ϴ����ͷ��ʱʼDZ������ڷ��������������ѧϰ���롣

�й�������Ϣ����ѡ����������֮һ��

����

���� Windows �ͻ��� (p. 13)

���� Linux �� macOS �ͻ��� (p. 13)

���� Windows �ͻ���

��

��ȷ����ӵ������ SSH ���������������Ϣ��

Amazon EC2 ʵ���Ĺ��� DNS ���ơ��������� EC2 ����̨���ҵ����� DNS ���ơ�

˽����Կ�ļ�����Կ�ԡ��йط�����Կ�Եĸ�����Ϣ������� Amazon EC2 �û�ָ��(������ Linux ʵ

��) �е� Amazon EC2 ��Կ�ԡ�

�� Windows �ͻ���ʹ�� Jupyter �ʼDZ�

�������Щ���ڴ� Windows �ͻ������ӵ����� Amazon EC2 ʵ����ָ�ϡ�

1. �Ų�ʵ������������

2. ʹ�� PuTTY �� Windows ���ӵ� Linux ʵ��

Ҫ�������� Jupyter �������������������������� Windows �ͻ����ϰ�װ Git Bash��Ȼ���� Linux

macOS �ͻ���˵��������������������ʹ���κη��������˿�ӳ��� SSH ����������� Jupyter ����

���˽������Ϣ��

��һ��

���� Linux �� macOS �ͻ��� (p. 13)

���� Linux �� macOS �ͻ���

1. ���նˡ�

2. ����������������ض˿� 8888 �ϵ���������ת����Զ�� Amazon EC2 ʵ���ϵĶ˿� 8888��ͨ����

����Կλ������������Է��� Amazon EC2 ʵ�������� Amazon EC2 ʵ���Ĺ��� DNS ���ơ�ע�⣬���� Amazon Linux AMI���û����� ec2-user ���� ubuntu��

ssh -i ~mykeypair.pem -N -f -L 8888:localhost:8888 ubuntu@ec2----

.compute-1.amazonaws.com

�����������Ŀͻ��������� Jupyter Notebook ��������Զ�� Amazon EC2 ʵ��֮���һ��������

��һ��

��¼ Jupyter Notebook ���������в��� (p. 14)

13���ѧϰ AMI ������Աָ��

��¼ Jupyter Notebook ������

��¼ Jupyter Notebook ���������в���

���ڣ��������������ɵ�¼�� Jupyter Notebook ��������

��������ͨ�����������������������ӡ�

1. ��������ĵ�ַ���У��������� URL���������ӣ�https:localhost:8888

2. ������ǩ�� SSL ֤�飬����������ᾯ�����ʾ���������������վ��

�����������Լ����õģ����Կ���ȫ�ؼ������������������������п��ܳ��֡�����������ʾ��ϸ��

Ϣ�������ư�ť��

14���ѧϰ AMI ������Աָ��

��¼ Jupyter Notebook ������

��������Ϣ��Ȼ����proceed to localhost��(ǰ������������)���ӡ�������ӳɹ�����ῴ��

Jupyter Notebook ��������ҳ����ʱ��ϵͳ��Ҫ�����ṩ��ǰ���õ����롣

15���ѧϰ AMI ������Աָ��

��¼ Jupyter Notebook ������

���ڣ������Է��� DLAMI �����е� Jupyter Notebook �������ˡ������Դ����µıʼDZ��������ṩ

�Ľ̳� (p. 22)��

16���ѧϰ AMI ������Աָ��

Conda DLAMI

ʹ�� DLAMI

����

ʹ�� ���� Conda �� Deep Learning AMI (p. 17)

ʹ�� Deep Learning Base AMI (p. 20)

���� Jupyter �ʼDZ����Խ̳� (p. 21)

�̳� (p. 22)

���²��ֽ������ʹ�� ���� Conda �� Deep Learning AMI �л���������ÿ���������ʾ�������Լ�����

Jupyter���Ա������Գ��Բ�ͬ�ıʼDZ��̡̳�

ʹ�� ���� Conda �� Deep Learning AMI

����

���� Conda �� Deep Learning AMI ��� (p. 17)

���� 1����¼���� DLAMI (p. 17)

���� 2������ MXNet Python 3 ���� (p. 18)

���� 3������ij٠MXNet ���� (p. 19)

���� 4����� TensorFlow ���� (p. 19)

ɾ������ (p. 20)

���� Conda �� Deep Learning AMI ���

Conda ��һ����Դ���������ϵͳ�ͻ�������ϵͳ���� Windows��macOS �� Linux �����С�Conda ���ٰ�

װ�����к��³�������������Conda �����ɴ��������桢���غ��л����ؼ�����ϵĻ�����

���� Conda �� Deep Learning AMI ��������ã��Ա����������л����ѧϰ����������˵��Ϊ��������

conda ��ص�һЩ����������ǻ�����������֤��ܵĻ��������������У�����������ʹ�ÿ������һ

Щ������Ȼ�������Լ����鿴�� DLAMI �ṩ�ĸ�ȫ��Ľ̳̣�����ÿ����ܵ���Ŀվ�����ṩ�Ŀ��

ʾ����

���� 1����¼���� DLAMI

��¼�����������ῴ���������ġ�ÿ����Ϣ��(MOTD)���������˿��������л���ͬ���ѧϰ��ܵĸ���

Conda ���������ʾ�� MOTD�������°汾 DLAMI �ķ����������ض� MOTD ���ܲ�ͬ��

=============================================================================

__| __|_ )

_| ( Deep Learning AMI (Ubuntu)

___|\___|___|

=============================================================================

Welcome to Ubuntu 16.04.4 LTS (GNULinux 4.4.0-1062-aws x86_64v)

Please use one of the following commands to start the required environment with the

framework of your choice:

17���ѧϰ AMI ������Աָ��

���� 2������ MXNet Python 3 ����

for MXNet(+Keras2) with Python3 (CUDA 9.0 and Intel MKL-DNN)

_______________________________ source activate mxnet_p36

for MXNet(+Keras2) with Python2 (CUDA 9.0 and Intel MKL-DNN)

_______________________________ source activate mxnet_p27

for TensorFlow(+Keras2) with Python3 (CUDA 9.0 and Intel MKL-DNN) _____________________

source activate tensorflow_p36

for TensorFlow(+Keras2) with Python2 (CUDA 9.0 and Intel MKL-DNN) _____________________

source activate tensorflow_p27

for Theano(+Keras2) with Python3 (CUDA 9.0) _______________________________________________

source activate theano_p36

for Theano(+Keras2) with Python2 (CUDA 9.0) _______________________________________________

source activate theano_p27

for PyTorch with Python3 (CUDA 9.0 and Intel MKL) ________________________________________

source activate pytorch_p36

for PyTorch with Python2 (CUDA 9.0 and Intel MKL) ________________________________________

source activate pytorch_p27

for CNTK(+Keras2) with Python3 (CUDA 9.0 and Intel MKL-DNN)

_________________________________ source activate cntk_p36

for CNTK(+Keras2) with Python2 (CUDA 9.0 and Intel MKL-DNN)

_________________________________ source activate cntk_p27

for Caffe2 with Python2 (CUDA 9.0) ________________________________________________________

source activate caffe2_p27

for Caffe with Python2 (CUDA 8.0)

__________________________________________________________ source activate caffe_p27

for Caffe with Python3 (CUDA 8.0)

__________________________________________________________ source activate caffe_p35

for Chainer with Python2 (CUDA 9.0 and Intel iDeep) ______________________________________

source activate chainer_p27

for Chainer with Python3 (CUDA 9.0 and Intel iDeep) ______________________________________

source activate chainer_p36

for base Python2 (CUDA 9.0)

__________________________________________________________________ source activate python2

for base Python3 (CUDA 9.0)

__________________________________________________________________ source activate python3

ÿ�� Conda �����������ģʽ��

source activate framework_python-version

���磬�����ܻῴ�� for MXNet(+Keras1) with Python3 (CUDA 9) _____________________

source activate mxnet_p36������ζ�Ÿû������� MXNet��Keras 1��Python 3 �� CUDA 9��Ҫ����

�˻�����������ʹ���������

source activate mxnet_p36

���������һ�������ǣ�

source activate mxnet_p27

����ζ�Ÿû������� MXNet �� Python 2 (ʹ�� Keras 1 �� CUDA 9)��

���� 2������ MXNet Python 3 ����

�������Ȳ��� MXNet���Ա������˽����ж�ô��

Note

���������ĵ�һ�� Conda ����ʱ������������ڼ����ĵȴ������� Conda �� Deep Learning AMI

���ڿ���״μ���ʱ�Զ�Ϊ���� EC2 ʵ����װ��ܵ����Ż��汾������Ӧ�����������ӳ١�

18���ѧϰ AMI ������Աָ��

���� 3������ij٠MXNet ����

���������� Python 3 �� MXNet �������

source activate mxnet_p36

�⽫����ʹ�� Python 3 �� MXNet ���������ߣ���Ҳ���Լ��� mxnet_p27���Թ���ʹ�� Python 2 �Ļ�����

���� 3������ij٠MXNet ����

Ҫ�������İ�װ����ʹ�� Python ��д MXNet ���룬��ʹ�� NDArray API ��������ӡ���顣�йظ�����

Ϣ������� NDArray API��

1. ���� iPython �նˡ�

(mxnet_p36) ipython

2. ���� MXNet��

import mxnet as mx

�����ܻῴ��һ�����ڵ������������ľ�����Ϣ�������Ժ�������

3. ����һ�� 5x5 ����һ�� NDArray ʵ������Ԫ�س�ʼ��Ϊ 0����ӡ���顣

mx.ndarray.zeros((5,5)).asnumpy

��֤�����

array([[ 0., 0., 0., 0., 0.],[ 0., 0., 0., 0., 0.],[ 0., 0., 0., 0., 0.],[ 0., 0., 0., 0., 0.],[ 0., 0., 0., 0., 0.]], dtype=float32)

�������� MXNet �̳̲����ҵ� MXNet �ĸ���ʾ����

���� 4����� TensorFlow ����

�������ǽ��л��� TensorFlow! �������Ȼ���� iPython ����̨�У���ʹ�� quit��Ȼ�����л�������

1. ���������� Python 3 �� TensorFlow �������

source activate tensorflow_p36

2. ���� iPython �նˡ�

(tensorflow_36) ipython

3. ����� TensorFlow ����

import tensorflow as tf

hello = tf.constant('Hello, TensorFlow!')

sess = tf.Session

19���ѧϰ AMI ������Աָ��

ɾ������

print(sess.run(hello))

��Ӧ�ûῴ����Hello, Tensorflow!�� ���ڣ����Ѳ��������ֲ�ͬ�����ѧϰ��ܣ������˽�����л���ܡ�

Tip

�й���֪�������Ϣ������ķ���˵����

Deep Learning AMI (Ubuntu) ��֪���� (p. 162)

Deep Learning AMI (Amazon Linux) ��֪���� (p. 159)

��������

���� Jupyter �ʼDZ����Խ̳� (p. 21)

ɾ������

ע�⣺������þ��� DLAMI �ϵĿռ䣬�����ѡ��ж�ز��õ� Conda ��������

conda env list

conda env remove �Cname

ʹ�� Deep Learning Base AMI

ʹ�� Deep Learning Base AMI

Base AMI ���� GPU �����������ƽ̨���Լ��������������Լ����Զ������ѧϰ�����ļ��ٿ⡣Ĭ�����

�£��� AMI ����Ϊ���� NVIDIA CUDA 10 ���������ǣ���Ҳ�����л��� CUDA 9 �� CUDA 8 �������й���

��ִ�д˲��������������˵����

���� CUDA �汾

������ʹ������ bash ����ѡ����֤�ض� CUDA �汾��

CUDA 10��

sudo rm usrlocalcuda

sudo ln -s usrlocalcuda-10.0 usrlocalcuda

CUDA 9.2��

sudo rm usrlocalcuda

sudo ln -s usrlocalcuda-9.2 usrlocalcuda

CUDA 9��

sudo rm usrlocalcuda

sudo ln -s usrlocalcuda-9.0 usrlocalcuda

CUDA 8��

20���ѧϰ AMI ������Աָ��

Jupyter �ʼDZ�����

sudo rm usrlocalcuda

sudo ln -s usrlocalcuda-8.0 usrlocalcuda

Tip

Ȼ��������ͨ������ NVIDIA �� deviceQuery ������֤ CUDA �汾��

cd usrlocalcudasamples1_UtilitiesdeviceQuery

sudo make

.deviceQuery

���� Jupyter �ʼDZ����Խ̳�

ÿ�����ѧϰ��Ŀ��Դ���붼�����˽̳̺�ʾ�������������£����ǿ������κ� DLAMI �����С������ѡ

���� ���� Conda �� Deep Learning AMI (p. 3)����ô�������һЩ�Ѿ����������ó��Եľ�ѡ�̵̳Ķ���

��

Important

Ҫ���а�װ�� DLAMI �ϵ� Jupyter �ʼDZ����Խ̳̣�����Ҫ���� Jupyter Notebook ����

�� (p. 11)��

Jupyter ���������к�������ͨ�� Web �����������Щ�̡̳�������������� ���� Conda �� Deep

Learning AMI ����������Ѿ������� Python ����������Դ� Jupyter �ʼDZ������л� Python �ںˡ��ڳ���

�����ض��ڿ�ܵĽ̳�֮ǰ����ѡ����ʵ��ںˡ�����Ϊ ���� Conda �� Deep Learning AMI �û��ṩ�˸�

���ⷽ���ʾ����

Note

����̳���ҪһЩ���� Python ģ�飬���������� DLAMI �Ͽ�����δ���á�������յ����� xyz

module not found �Ĵ������¼�� DLAMI�������(��������)��Ȼ��װ��Ҫ��ģ

�顣

Tip

���ѧϰ�̳̺�ʾ��ͨ��������һ������ GPU���������ʵ������û�� GPU����������Ҫ����

һЩʾ���������ʹ�����С�

�����Ѱ�װ�Ľ̳�

һ������¼�� Jupyter �������ҿ��Կ����̳�Ŀ¼(���� ���� Conda �� Deep Learning AMI ��)ʱ��Ҳ��

������ÿ������������еĽ̳��ļ��С������û�п���ij����ܣ������������ǰ DLAMI �ϸÿ�ܵĽ̳�

�����á�������������Բ鿴�г��Ľ̳̣�Ȼ��һ���̳̣�����������

�� ���� Conda �� Deep Learning AMI �ϵ�һ�����бʼDZ�����ʱ��������֪������ʹ���ĸ�������������

ʾ�����б��н���ѡ��ÿ����������������ģʽ������

Environment (conda_framework_python-version)

���磬�����ܻῴ�� Environment (conda_mxnet_p36)������ζ�Ÿû������� MXNet �� Python 3����

Ҳ���ܻῴ�� Environment (conda_mxnet_p27)������ζ�Ÿû������� MXNet �� Python 2��

21���ѧϰ AMI ������Աָ��

ͨ�� Jupyter �л�����

Tip

�������֪���ĸ��汾�� CUDA ���ڻ״̬��һ�ֲ鿴���������״ε�¼�� DLAMI ʱ�� MOTD

�в鿴��

ͨ�� Jupyter �л�����

�������������һ����ͬ��ܵĽ̳̣�һ��Ҫ��֤��ǰ�������е��ںˡ�����Ϣ������ Jupyter ����

�����Ϸ�����������ע����ť���·������������κδıʼDZ������ϸ����ںˣ����������ε���

Kernel��Change Kernel �˵��Ȼ�������еıʼDZ������ʺϵĻ�����

��ʱ����Ҫ���������κε�Ԫ����Ϊ�ں��еĸ��Ľ������֮ǰ���е��κ����ݵ�״̬��

Tip

�ڿ��֮������л����ܺ���Ȥ���Һ��н������壬���ǿ��ܵ��ºľ��ڴ档�������ʼ������

����鿴���� Jupyter ���������ն˴��ڡ�����������õ���Ϣ�ʹ����¼�������ܻῴ���ڴ�

����Ĵ���Ҫ�����һ���⣬������ת�� Jupyter ����������ҳ�У����� Running ѡ���Ȼ��

Ϊÿ���̵̳��� Shutdown����Ϊ��Щ�̳̿�����Ȼ�ں�̨���У����ºľ��������ڴ档

��������

�й�ÿ����ܵĸ���ʾ����ʾ�����룬�뵥�� Next ����� Apache MXNet (incubating) (p. 23)��

�̳�

�������й����ʹ�� ���� Conda �� Deep Learning AMI �������Ľ̡̳�

����

10 ���ӽ̳� (p. 22)

������ (p. 22)

���ԺͿ��ӻ� (p. 33)

�ֲ�ʽѵ�� (p. 36)

GPU ��غ��Ż� (p. 52)

���� (p. 57)

��������� ONNX (p. 60)

ģ�ʹ��� (p. 68)

10 ���ӽ̳�

���� AWS Deep Learning AMI (�� 10 ������)

�� Amazon EC2 ��ʹ�� AWS Deep Learning Containers ѵ�����ѧϰģ��(10 ����)

������

������ ���� Conda �� Deep Learning AMI �ϰ�װ�����ѧϰ��ܡ�����ij����ܼ����˽���ν��伤�

����

22���ѧϰ AMI ������Աָ��

������

Apache MXNet (incubating) (p. 23)

Caffe2 (p. 24)

Chainer (p. 25)

CNTK (p. 26)

Keras (p. 27)

PyTorch (p. 28)

TensorFlow (p. 30)

TensorFlow with Horovod (p. 31)

Theano (p. 32)

Apache MXNet (incubating)

���� MXNet

���̳̽������������ ���� Conda �� Deep Learning AMI (DLAMI on Conda) ��ʵ���ϼ��� MXNet ������

MXNet ����

����ܵ��ȶ��� Conda ���������ʱ�������� DLAMI �Ͻ��в��Բ�Ԥ��װ�������ϣ���������µġ�δ��

���Ե�ÿ�չ����汾���������ֶ���װ MXNet ��ÿ�չ����汾(����) (p. 23)��

�� DLAMI with Conda ������ MXNet

1. Ҫ����ÿ�ܣ���� DLAMI with Conda �� Amazon Elastic Compute Cloud (Amazon EC2) ʵ����

����ʹ�� CUDA 9.0 �� MKL-DNN �� Python 3 �ϵ� MXNet �� Keras 2�������������

source activate mxnet_p36

����ʹ�� CUDA 9.0 �� MKL-DNN �� Python 2 �ϵ� MXNet �� Keras 2�������������

source activate mxnet_p27

2. ���� iPython �նˡ�

(mxnet_p36) ipython

3. ���п��� MXNet ������һ�� 5x5 ����һ�� NDArray ʵ������Ԫ�س�ʼ��Ϊ 0����ӡ���顣

import mxnet as mx

mx.ndarray.zeros((5,5)).asnumpy

4. ��֤�����

array([[ 0., 0., 0., 0., 0.],[ 0., 0., 0., 0., 0.],[ 0., 0., 0., 0., 0.],[ 0., 0., 0., 0., 0.],[ 0., 0., 0., 0., 0.]], dtype=float32)

��װ MXNet ��ÿ�չ����汾(����)

�����Խ����µ� MXNet �����汾��װ������ ���� Conda �� Deep Learning AMI �ϵ���һ������ MXNet

Conda ������

23���ѧϰ AMI ������Աָ��

������

��ÿ�չ����汾��װ MXNet

1. ? ���� Python 3 MXNet �������������������

source activate mxnet_p36

���� Python 2 MXNet �������������������

source activate mxnet_p27

2. ɾ����ǰ��װ�� MXNet��

Note

���ಽ��ٶ���ʹ�õ��� mxnet_p36 ������

(mxnet_p36) pip uninstall mxnet-cu90mkl

3. ��װ MXNet �����µ�ÿ�չ����汾��

(mxnet_p36) pip install --pre mxnet-cu90mkl

4. Ҫ��֤���Ƿ��ѳɹ���װ���µ�ÿ�չ����汾�������� IPython �ն˲���� MXNet �汾��

(mxnet_p36) ipython

import mxnet

print (mxnet.__version__)

���Ӧ��ӡ MXNet �������ȶ��汾��

����̳�

�������� DLAMI ��Ŀ¼�� ���� Conda �� Deep Learning AMI �̳��ļ������ҵ�����̡̳�

1. �� Apache MXNet for Inference �� ResNet 50 ģ�ͽ��ʹ�� (p. 58)

2. �������������� Apache MXNet �� ONNX ģ�ͽ��ʹ�� (p. 57)

3. ������ Apache MXNet ��ģ�ͷ����� (MMS) (p. 68)

�йظ���̳̺�ʾ��������ĸÿ�ܵĹٷ� Python �ĵ��������� MXNet �� Python API �� Apache MXNet

��վ��

Caffe2

Caffe2 �̳�

Ҫ�����ܣ��밴������ ���� Conda �� Deep Learning AMI �ϵ���Щ˵�����в�����

ֻ��ʹ�� CUDA 9 �� cuDNN 7 �� Python 2 ѡ�

source activate caffe2_p27

���� iPython �նˡ�

24���ѧϰ AMI ������Աָ��

������

(caffe2_p27) ipython

����� Caffe2 ����

from caffe2.python import workspace, model_helper

import numpy as np

Create random tensor of three dimensions

x = np.random.rand(4, 3, 2)

print(x)

print(x.shape)

workspace.FeedBlob(my_x, x)

x2 = workspace.FetchBlob(my_x)

print(x2)

��Ӧ�ûῴ��ϵͳ�����ʼ numpy ������飬Ȼ����Щ������ص��� Caffe2 blob �С���ע�⣬����֮����������ͬ�ġ�

����̳�

����鿴����̳̺�ʾ��������ĸÿ�ܵĹٷ� Python �ĵ���Python API for Caffe2 �� Caffe2 ��վ��

Chainer

Chainer ��һ�ֻ��� Python ������ܣ���������ֱ�۵ر�д���ӵ�������ܹ������� Chainer��������

����ʹ�ö� GPU ʵ������ѵ����Chainer �����Զ���¼�����ͼ����ʧ�;��Ȳ���������ʹ�ü���ͼ������

��������������Chainer ������ ���� Conda �� Deep Learning AMI (DLAMI with Conda) ��

���� Chainer

1. ���ӵ��������� ���� Conda �� Deep Learning AMI ��ʵ�����й����ѡ������ӵ�ʵ���������the

section called ��ʵ��ѡ�� (p. 6)�� Amazon EC2 �ĵ���

2. ? ���� Python 3 Chainer ������

source activate chainer_p36

���� Python 2 Chainer ������

source activate chainer_p27

3. ���� iPython �նˣ�

(chainer_p36) ipython

4. ���Ե��� Chainer ����֤���Ƿ�����������

import chainer

�����ܻῴ������������Ϣ����û�д���

������Ϣ

�볢���й�Chainer (p. 36) �Ľ̡̳�

25���ѧϰ AMI ������Աָ��

������

��֮ǰ���ص�λ��Դ�ڵ� Chainer ʾ���ļ��а�������ʾ������������Щʾ�����˽������ܡ�

Ҫ�˽��й� Chainer �ĸ�����Ϣ������� Chainer �ĵ���վ��

CNTK

���� CNTK

���̳̽������������ ���� Conda �� Deep Learning AMI (DLAMI on Conda) ��ʵ���ϼ��� CNTK ������

CNTK ����

����ܵ��ȶ��� Conda ���������ʱ�������� DLAMI �Ͻ��в��Բ�Ԥ��װ�������ϣ���������µġ�δ��

���Ե�ÿ�չ����汾���������ֶ���װ CNTK ��ÿ�չ����汾(����) (p. 26)��

�� DLAMI with Conda ������ CNTK

1. Ҫ���� CNTK����� DLAMI with Conda �� Amazon Elastic Compute Cloud (Amazon EC2) ʵ����

����ʹ�� CUDA 9 �� cuDNN 7 �� Python 3��

source activate cntk_p36

����ʹ�� CUDA 9 �� cuDNN 7 �� Python 2��

source activate cntk_p27

2. ���� iPython �նˡ�

(cntk_p36) ipython

3. ? ��������� CPU ʵ���������д˿��� CNTK ����

import cntk as C

C.__version__

c = C.constant(3, shape=(2,3))

c.asarray

��Ӧ�ÿ��� CNTK �汾��Ȼ�����һ�� 2x3 �� 3 ���顣

������� GPU ʵ��������ʹ�����´���ʾ��������в��ԡ���� CNTK ���Է��� GPU���� True

�Ľ���������������ġ�

from cntk.device import try_set_default_device, gpu

try_set_default_device(gpu(0))

��װ CNTK ��ÿ�չ����汾(����)

�����Խ����µ� CNTK �汾��װ�� ���� Conda �� Deep Learning AMI �ϵ���һ������ CNTK Conda ��

����

��ÿ�չ�����װ CNTK

1. ? ����ʹ�� CUDA 9.0 �� MKL-DNN �� Python 3 �ϵ� CNTK �� Keras 2�������������

source activate cntk_p36

26���ѧϰ AMI ������Աָ��

������

����ʹ�� CUDA 9.0 �� MKL-DNN �� Python 2 �ϵ� CNTK �� Keras 2�������������

source activate cntk_p27

2. ���ಽ��ٶ���ʹ�õ��� cntk_p36 ������ɾ����ǰ��װ�� CNTK��

(cntk_p36) pip uninstall cntk

3. Ҫ��װ CNTK ÿ�չ�������������Ҫ�� CNTK ÿ�չ�����վ������Ҫ��װ�İ汾��

4. ? (������ GPU ʵ����ѡ��)- Ҫ��װÿ�չ����汾������ʹ���������ݣ��Ӷ�������Ĺ����汾��

�����滻��

(cntk_p36) pip install https:cntk.aiPythonWheelGPUlatest-nightly-build

����һ�������е� URL �滻Ϊ���ĵ�ǰ Python ������ GPU �汾��

(������ CPU ʵ����ѡ��)- Ҫ��װÿ�չ����汾������ʹ���������ݣ��Ӷ�������Ĺ����汾��

�����滻��

(cntk_p36) pip install https:cntk.aiPythonWheelCPU-Onlylatest-nightly-build

����һ�������е� URL �滻Ϊ���ĵ�ǰ Python ������ CPU �汾��

5. Ҫ��֤���ѳɹ���װ���µ�ÿ�չ����汾�������� IPython �ն˲���� CNTK �İ汾��

(cntk_p36) ipython

import cntk

print (cntk.__version__)

���Ӧ�������������ݣ�2.6-rc0.dev20181015

����̳�

�йظ���̳̺�ʾ��������ĸÿ�ܵĹٷ� Python �ĵ���Python API for CNTK �� CNTK ��վ��

Keras

Keras �̳�

1. Ҫ����˿�ܣ���������the section called ��Conda DLAMI�� (p. 17) CLI ��ʹ����Щ���

����ʹ�� CUDA 9 �� cuDNN 7 �� Python 3 �ϵľ��� MXNet ��˵� Keras 2��

source activate mxnet_p36

����ʹ�� CUDA 9 �� cuDNN 7 �� Python 2 �ϵľ��� MXNet ��˵� Keras 2��

source activate mxnet_p27

����ʹ�� CUDA 9 �� cuDNN 7 �� Python 3 �Ͼ��� TensorFlow ��˵� Keras 2��

source activate tensorflow_p36

������ʹ�� CUDA 9 �� cuDNN 7 �� Python 2 �Ͼ��� TensorFlow ��˵� Keras 2��

27���ѧϰ AMI ������Աָ��

������

source activate tensorflow_p27

2. Ҫ���Ե��� Keras ����֤������Щ��ˣ���ʹ����Щ���

ipython

import keras as k

��������Ӧ��ʾ������Ļ�ϣ�

Using MXNet backend

��� Keras ʹ�õ��� TensorFlow�������ʾ�������ݣ�

Using TensorFlow backend

Note

������յ������������ʹ�ô���ĺ�ˣ�������ֶ��������� Keras ���á��༭

~.keraskeras.json �ļ�����������ø���Ϊ mxnet �� tensorflow��

����̳�

�й�ʹ�þ��� MXNet ��˵� Keras �Ķ� GPU �̳̣��볢��Keras-MXNet Multi-GPU ѵ����

�� (p. 45)��

�������� ���� Conda �� Deep Learning AMI ~exampleskeras-mxnet Ŀ¼�в����йؾ��� MXNet

��˵� Keras ��ʾ����

�������� ���� Conda �� Deep Learning AMI ~exampleskeras Ŀ¼�в����йؾ��� TensorFlow ���

�� Keras ��ʾ����

�й������̳̺�ʾ��������� Keras ��վ��

PyTorch

���� PyTorch

����ܵ��ȶ��� Conda ���������ʱ�������� DLAMI �Ͻ��в��Բ�Ԥ��װ�������ϣ���������µġ�δ��

���Ե�ÿ�չ����汾���������ֶ���װ PyTorch ��ÿ�չ����汾(����) (p. 29)��

Ҫ���ǰ��װ�Ŀ�ܣ��밴������ ���� Conda �� Deep Learning AMI �ϵ���Щ˵�����в�����

���ھ��� CUDA 10 �� MKL-DNN �� Python 3 �ϵ� PyTorch�������������

source activate pytorch_p36

���ھ��� CUDA 10 �� MKL-DNN �� Python 2 �ϵ� PyTorch�������������

source activate pytorch_p27

���� iPython �նˡ�

(pytorch_p36) ipython

28���ѧϰ AMI ������Աָ��

������

����� PyTorch ����

import torch

x = torch.rand(5, 3)

print(x)

print(x.size)

y = torch.rand(5, 3)

print(torch.add(x, y))

��Ӧ�ûῴ��ϵͳ�����ʼ������飬Ȼ�������С��Ȼ��������һ��������顣

��װ PyTorch ��ÿ�չ����汾(����)

��δ�ÿ�չ�����װ PyTorch

�����Խ����µ� PyTorch �����汾��װ������ ���� Conda �� Deep Learning AMI �ϵ���һ������ PyTorch

Conda ������

1. ? (������ Python 3 ��ѡ��)- ���� Python 3 PyTorch ������

source activate pytorch_p36

(������ Python 2 ��ѡ��)- ���� Python 2 PyTorch ������

source activate pytorch_p27

2. ���ಽ��ٶ���ʹ�õ��� pytorch_p36 ������ɾ����ǰ��װ�� PyTorch��

(pytorch_p36) pip uninstall torch

3. ? (������ GPU ʵ����ѡ��)- ʹ�� CUDA 10.0 ��װ���µ� PyTorch ÿ�չ����汾��

(pytorch_p36) pip install torch_nightly -f https:download.pytorch.orgwhl

nightlycu100torch_nightly.html

(������ CPU ʵ����ѡ��)- ���ڲ�ʹ�� GPU ��ʵ������װ���µ� PyTorch ÿ�չ����汾��

(pytorch_p36) pip install torch_nightly -f https:download.pytorch.orgwhl

nightlycputorch_nightly.html

4. Ҫ��֤���ѳɹ���װ���µ�ÿ�չ����汾�������� IPython �ն˲���� PyTorch �汾��

(pytorch_p36) ipython

import torch

print (torch.__version__)

���Ӧ�������������ݣ�1.0.0.dev20180922

5. Ҫ��֤ PyTorch ÿ�չ����汾�Ƿ������� MNIST ʾ���������Դ� PyTorch ��ʾ���洢�����в��Խ�

����

(pytorch_p36) cd ~

(pytorch_p36) git clone https:github.compytorchexamples.git pytorch_examples

(pytorch_p36) cd pytorch_examplesmnist

(pytorch_p36) python main.py || exit 1

29���ѧϰ AMI ������Աָ��

������

����̳�

�������� DLAMI ��Ŀ¼�� ���� Conda �� Deep Learning AMI �̳��ļ������ҵ�����̡̳�����鿴�����

�̺�ʾ��������ĸÿ�ܵĹٷ��ĵ���PyTorch �ĵ��� PyTorch ��վ��

�йؽ� PyTorch ת��Ϊ ONNX��Ȼ����ص� MXNet �Ľ̳� (p. 66)

�йؽ� PyTorch ת��Ϊ ONNX��Ȼ����ص� CNTK �Ľ̳� (p. 64)

TensorFlow

���� TensorFlow

���̳̽������������ ���� Conda �� Deep Learning AMI (DLAMI on Conda) ��ʵ���ϼ��� TensorFlow ��

���� TensorFlow ����

����ܵ��ȶ��� Conda ���������ʱ�������� DLAMI �Ͻ��в��Բ�Ԥ��װ�������ϣ���������µġ�δ��

���Ե�ÿ�չ����汾���������ֶ���װ TensorFlow ��ÿ�չ����汾(����) (p. 30)��

�� DLAMI with Conda ������ TensorFlow

1. Ϊ�˼��� TensorFlow���� DLAMI with Conda �� Amazon Elastic Compute Cloud (Amazon EC2) ʵ

����

���ھ��� CUDA 9.0 �� MKL-DNN �� Python 3 �ϵ� TensorFlow �� Keras 2�������������

source activate tensorflow_p36

���ھ��� CUDA 9.0 �� MKL-DNN �� Python 2 �ϵ� TensorFlow �� Keras 2�������������

source activate tensorflow_p27

2. ���� iPython �նˣ�

(tensorflow_p36) ipython

3. ���� TensorFlow ��������֤���Ƿ��������У�

import tensorflow as tf

hello = tf.constant('Hello, TensorFlow!')

sess = tf.Session

print(sess.run(hello))

Hello, TensorFlow! Ӧ��ʾ��������Ļ�ϡ�

��װ TensorFlow ��ÿ�չ����汾(����)

�����Խ����µ� TensorFlow �汾��װ������ ���� Conda �� Deep Learning AMI �ϵ���һ������

TensorFlow Conda ������

��ÿ�չ����汾��װ TensorFlow

1. ? ���� Python 3 TensorFlow �����������������

source activate tensorflow_p36

30���ѧϰ AMI ������Աָ��

������

���� Python 2 TensorFlow �����������������

source activate tensorflow_p27

2. ɾ����ǰ��װ�� TensorFlow��

Note

���ಽ��ٶ���ʹ�õ��� mxnet_p36 ������

(tensorflow_p36) pip uninstall tensorflow

3. ��װ TensorFlow ������ÿ�չ����汾��

(tensorflow_p36) pip install tf-nightly

4. Ҫ��֤���Ƿ��ѳɹ���װ���µ�ÿ�չ����汾�������� IPython �ն˲���� TensorFlow �汾��

(tensorflow_p36) ipython

import tensorflow

print (tensorflow.__version__)

���Ӧ�������������ݣ�1.12.0-dev20181012

����̳�

TensorFlow with Horovod (p. 46)

TensorBoard (p. 35)

TensorFlow Serving (p. 69)

�йؽ̳̣������ DLAMI ����Ŀ¼����Ϊ Conda Deep Learning AMI tutorials ���ļ��С�

�йظ���̳̺�ʾ��������� TensorFlow Python API �� TensorFlow �ĵ������ TensorFlow ��վ��

TensorFlow with Horovod

���̳̽�������� AWS Deep Learning AMI (DLAMI) with Conda �ϼ��� TensorFlow with

Horovod��Horovod ��Ϊ TensorFlow Ԥ��װ�� Conda �����С��Ƽ�ʹ�� Python3 ������

Note

��֧�� P3.��P2. �� G3. ʵ�����͡�

�� DLAMI with Conda �ϼ��� TensorFlow ������ Horovod

1. �� DLAMI with Conda �� Amazon Elastic Compute Cloud (Amazon EC2) ʵ�����й� DLAMI ���Ű�

���������the section called ����ο�ʼʹ�� DLAMI�� (p. 3)��

(�Ƽ�)����ʹ�� CUDA 9 �� Python 3 �ϵ� TensorFlow with Horovod�������д����

source activate tensorflow_p36

����ʹ�� CUDA 9 �� Python 2 �ϵ� TensorFlow with Horovod�������д����

source activate tensorflow_p27

31���ѧϰ AMI ������Աָ��

������

2. ���� iPython �նˣ�

(tensorflow_p36) ipython

3. ���Ե��� TensorFlow with Horovod ����֤���Ƿ�����������

import horovod.tensorflow as hvd

hvd.init

�������ݿ�����ʾ��������Ļ��(�����ܻ�����κξ�����Ϣ)��--------------------------------------------------------------------------

[[55425,1],0]: A high-performance Open MPI point-to-point messaging module

was unable to find any relevant network interfaces:

Module: OpenFabrics (openib)

Host: ip-172-31-72-4

Another transport will be used instead, although this may result in

lower performance.--------------------------------------------------------------------------

������Ϣ

TensorFlow with Horovod (p. 46)

�йؽ̳̣������ DLAMI ����Ŀ¼�е� exampleshorovod �ļ��С�

�йظ���̳̺�ʾ��������� Horovod GitHub ��Ŀ��

Theano

Theano �̳�

Ҫ�����ܣ��밴������ ���� Conda �� Deep Learning AMI �ϵ���Щ˵�����в�����

����ʹ�� CUDA 9 �� cuDNN 7 �� Python 3 �е� Theano + Keras��

source activate theano_p36

����ʹ�� CUDA 9 �� cuDNN 7 �� Python 2 �е� Theano + Keras��

source activate theano_p27

���� iPython �նˡ�

(theano_p36) ipython

����� Theano ����

32���ѧϰ AMI ������Աָ��

���ԺͿ��ӻ�

import numpy

import theano

import theano.tensor as T

from theano import pp

x = T.dscalar('x')

y = x 2

gy = T.grad(y, x)

pp(gy)

��Ӧ�ûῴ�� Theano ��������ݶȡ�

����̳�

����鿴����̳̺�ʾ��������ĸÿ�ܵĹٷ��ĵ���Theano Python API �� Theano ��վ��

���ԺͿ��ӻ�

�˽������� DLAMI �ĵ��ԺͿ��ӻ�ѡ���������һ��ѡ����˽����ʹ�ø�ѡ�

����

MXBoard (p. 33)

TensorBoard (p. 35)

MXBoard

MXBoard ������ʹ�� TensorBoard ����Ŀ�Ӽ��ͽ������� MXNet ���к�ͼ������������һ�� Web ����

�����÷������ṩ��һ�����ڲ鿴 MXBoard ���ӻ�����֮��������ҳ��

MXNet��TensorBoard �� MXBoard �� ���� Conda �� Deep Learning AMI (DLAMI with Conda) һ��Ԥ��

װ���ڱ��̳��У���ʹ�� MXBoard ���������� TensorBoard ���ݵ���־��

����

�� MXNet �� MXBoard ���ʹ�� (p. 33)

������Ϣ (p. 35)

�� MXNet �� MXBoard ���ʹ��

������ TensorBoard ���ݵ� MXBoard ��־����

1. ���ӵ� DLAMI with Conda �� Amazon Elastic Compute Cloud (Amazon EC2) ʵ����

2. ���� Python 3 MXNet ������

source activate mxnet_p36

3. �� Python �ű��Խ�һ����������ɵ�����д���¼��ļ��С��������� 10 �Σ���ƫ���С��Ȼ��ÿ

�ν�д�뵽�¼��ļ��С������������ݷֲ�����ƽ��ֵΪ���ġ���ע�⣬��������־�ļ�����ָ����

���ļ����������ļ���·�����ݵ� TensorBoard �������ļ���

vi mxboard_normal.py

4. ����������ճ�����ļ��в���������

33���ѧϰ AMI ������Աָ��

���ԺͿ��ӻ�

import mxnet as mx

from mxboard import SummaryWriter

with SummaryWriter(logdir='.logs') as sw:

for i in range(10):

create a normal distribution with fixed mean and decreasing std

data = mx.nd.normal(loc=0, scale=10.0(i+1), shape=(10, 3, 8, 8))

sw.add_histogram(tag='norml_dist', values=data, bins=200, global_step=i)

5. ���нű����⽫�� logs �ļ��������ɿ����ڿ��ӻ�����־��

python mxboard_normal.py

6. ���ڣ��������л��� TensorFlow ������ʹ�� TensorBoard �� MXBoard ���ӻ���־������ MXBoard ��

TensorBoard ����������

source activate tensorflow_p36

7. ����־��λ�ô��ݵ� tensorboard��

tensorboard --logdir=.logs --host=127.0.0.1 --port=8888

TensorBoard �ڶ˿� 8888 �������˿��ӻ� Web ��������

8. Ϊ�˷�������ı�����������з��ʣ������Խ� Web �������˿ڸ���Ϊ�˿� 80 �������˿ڡ�������ʹ

���ĸ��˿ڣ�����Ҫ�� EC2 ��ȫ����Ϊ���� DLAMI �˶˿ڡ���������ʹ�ö˿�ת�����йظ��İ�

ȫ�����úͶ˿�ת����˵������������� Jupyter Notebook ������ (p. 11)��Ĭ����������һ����������

Note

�������Ҫͬʱ���� Jupyter �������� MXBoard �����������ÿ��������ʹ�ò�ͬ�Ķ˿ڡ�

9. ������ EC2 ʵ���ϴ˿� 8888 (������������ӻ� Web �������Ķ˿�)��

a. �� https:console.aws.amazon.comec2 �ϵ� Amazon EC2 ����̨�д����� EC2 ʵ����

b. �� Amazon EC2 ����̨�У�ѡ�� Network Security (�����밲ȫ)��Ȼ��ѡ�� Security Groups (��

ȫ��)��

c. ���� Security Group (��ȫ��)��ѡ�����������һ����ȫ�� (����������е�ʱ���)��

d. ѡ�� Inbound (��վ) ѡ���Ȼ��ѡ�� Edit (�༭)��

e. ѡ�� Add Rule��

f. �������У������������ݣ�

���ͣ��Զ��� TCP Rule

Э�飺TCP

�˿ڷ�Χ��8888(������������ӻ��������Ķ˿�)

Դ��Anywhere (0.0.0.00,::0)

10. �������Ҫ�ӱ�����������ӻ����ݣ���������������Խ� EC2 ʵ������Ⱦ������ת�������ؼ������

ssh -Y -L localhost:8888:localhost:8888 user_id@ec2_instance_ip

11. ʹ������ DLAMI with Conda �� EC2 ʵ���Ĺ��� IP �� DNS ��ַ�Լ���Ϊ MXBoard �Ķ˿ڴ���

�� MXBoard ���ӻ�����ҳ��

http:127.0.0.1:8888

34���ѧϰ AMI ������Աָ��

���ԺͿ��ӻ�

������Ϣ

Ҫ�˽��й� MXBoard �ĸ�����Ϣ������� MXBoard ��վ��

TensorBoard

TensorBoard ���������Ӿ���ʽ���ͽ������� TensorFlow ���к�ͼ������������һ�� Web ���������÷�

�����ṩ��һ�����ڲ鿴 TensorBoard ���ӻ�����֮��������ҳ��

TensorFlow �� TensorBoard �� ���� Conda �� Deep Learning AMI (DLAMI with Conda) һ��Ԥ��

װ��DLAMI with Conda ������һ��ʾ���ű����ýű�ʹ�� TensorFlow ͨ�����ö������־��¼����ѵ��

MNIST ģ�͡�MNIST ��ͨ������ѵ��ͼ��ʶ��ģ�͵���д��ŵ����ݿ⡣�ڱ��̳��У�����ʹ�øýű���

ѵ�� MNIST ģ�͡�TensorBoard ����־���Դ������ӻ���

����

ѵ�� MNIST ģ�Ͳ�ʹ�� TensorBoard ��ѵ�����ӻ� (p. 35)

������Ϣ (p. 36)

ѵ�� MNIST ģ�Ͳ�ʹ�� TensorBoard ��ѵ�����ӻ�

ʹ�� TensorBoard �� MNIST ģ��ѵ�����ӻ�

1. ���ӵ� DLAMI with Conda �� Amazon Elastic Compute Cloud (Amazon EC2) ʵ����

2. ���� Python 2.7 TensorFlow ������������������ TensorBoard ʾ���ű����ļ������ڵ�Ŀ¼��

source activate tensorflow_p27

cd ~examplestensorboard

3. ����ѵ���������ӳ���־��¼�� MNIST ģ�͵Ľű���

python mnist_with_summaries.py

�ýű�����־д�� tmptensorflowmnist��

4. ����־��λ�ô��ݵ� tensorboard��

tensorboard --logdir=tmptensorflowmnist

TensorBoard �ڶ˿� 6006 �������˿��ӻ� Web ��������

5. Ϊ�˷�������ı�����������з��ʣ������Խ� Web �������˿ڸ���Ϊ�˿� 80 �������˿ڡ�������ʹ

���ĸ��˿ڣ�����Ҫ�� EC2 ��ȫ����Ϊ���� DLAMI �˶˿ڡ���������ʹ�ö˿�ת�����йظ��İ�

ȫ�����úͶ˿�ת����˵������������� Jupyter Notebook ������ (p. 11)��Ĭ����������һ����������

Note

�������Ҫͬʱ���� Jupyter �������� TensorBoard �����������ÿ��������ʹ�ò�ͬ�Ķ�

�ڡ�

6. ������ EC2 ʵ���ϴ˿� 6006 (������������ӻ� Web �������Ķ˿�)��

a. �� https:console.aws.amazon.comec2 �ϵ� Amazon EC2 ����̨�д����� EC2 ʵ����

b. �� Amazon EC2 ����̨�У�ѡ�� Network Security (�����밲ȫ)��Ȼ��ѡ�� Security Groups (��

ȫ��)��

c. ���� Security Group (��ȫ��)��ѡ�����������һ����ȫ��(����������е�ʱ���)��

d. ѡ�� Inbound (��վ) ѡ���Ȼ��ѡ�� Edit (�༭)��

35���ѧϰ AMI ������Աָ��

�ֲ�ʽѵ��

e. ѡ�� Add Rule��

f. �������У������������ݣ�

���ͣ��Զ��� TCP Rule

Э�飺TCP

�˿ڷ�Χ��6006(������������ӻ��������Ķ˿�)

Դ��Anywhere (0.0.0.00,::0)

7. ʹ������ DLAMI with Conda �� EC2 ʵ���Ĺ��� IP �� DNS ��ַ�Լ���Ϊ TensorBoard �Ķ˿ڴ�

������ TensorBoard ���ӻ�����ҳ��

http: YourInstancePublicDNS:6006

������Ϣ

Ҫ�˽��й� TensorBoard �ĸ�����Ϣ������� TensorBoard ��վ��

�ֲ�ʽѵ��

�˽� DLAMI ������ѵ����� GPU ��ѡ���������һ��ѡ����˽����ʹ�ø�ѡ�

����

Chainer (p. 36)

�� MXNet �� Keras (p. 45)

TensorFlow with Horovod (p. 46)

Chainer

Chainer ��һ�ֻ��� Python ������ܣ���������ֱ�۵ر�д���ӵ�������ܹ������� Chainer��������

����ʹ�ö� GPU ʵ������ѵ����Chainer �����Զ���¼�����ͼ����ʧ�;��Ȳ���������ʹ�ü���ͼ������

��������������Chainer ������ ���� Conda �� Deep Learning AMI (DLAMI with Conda) ��

���������������ڶ�� GPU������ GPU ��һ�� CPU �Ͻ���ѵ������δ������ӻ��Լ���β�������

Chainer ��װ��

����

ʹ�� Chainer ѵ��ģ�� (p. 36)

ʹ�� Chainer �ڶ�� GPU ��ѵ�� (p. 37)

ʹ�� Chainer �ڵ��� GPU ��ѵ�� (p. 39)

ʹ�� Chainer �� CPU ��ѵ�� (p. 40)

���ƽ�� (p. 41)

���� Chainer (p. 45)

������Ϣ (p. 45)

ʹ�� Chainer ѵ��ģ��

���̳̽������ʹ��ʾ�� Chainer �ű���ͨ�� MNIST ���ݼ�ѵ��ģ�͡�MNIST ��ͨ������ѵ��ͼ��ʶ��ģ

�͵���д��ŵ����ݿ⡣���̳̻���������һ�� CPU ��ѵ������һ������ GPU ��ѵ��֮���ѵ���ٶȲ�

�졣

36���ѧϰ AMI ������Աָ��

�ֲ�ʽѵ��

ʹ�� Chainer �ڶ�� GPU ��ѵ��

�ڶ�� GPU ��ѵ��

1. ���ӵ��������� ���� Conda �� Deep Learning AMI ��ʵ�����й����ѡ������ӵ�ʵ���������the

section called ��ʵ��ѡ�� (p. 6)�� Amazon EC2 �ĵ���Ҫ���д˽̳̣�������Ҫʹ�ô��������� GPU

��ʵ����

2. ���� Python 3 Chainer ������

source activate chainer_p36

3. Ҫ��ȡ���½̳̣����¡ Chainer �洢�Ⲣ������ʾ���ļ��У�

(chainer_p36) :~ cd ~src

(chainer_p36) :~src git clone https:github.comchainerchainer.git

(chainer_p36) :~src cd chainerexamplesmnist

4. �� train_mnist_data_parallel.py �ű�������ʾ����Ĭ������£��ýű�ʹ���� ���� Conda ��

Deep Learning AMI ��ʵ�������е� GPU���ýű����������� GPU �����С���������ǰ���� GPU

֮������� GPU�������Զ��������һ�� GPU ��������� GPU����������е��Dz��� GPU ��ʵ

�������������̳̺����ʹ�� Chainer �� CPU ��ѵ�� (p. 40)��

(chainer_p36) :~srcchainerexamplesmnist python train_mnist_data_parallel.py

Note

���ڰ���δ�� DLAMI �а��� beta ���ܣ���ʾ�����������´���

chainerx ModuleNotFoundError: No module named 'chainerx'

�� Chainer �ű�ʹ�� MNIST ���ݿ�ѵ��ģ��ʱ�����ῴ��ÿ����Ԫ�Ľ����

Ȼ�������ڽű�����ʱ����ʾ�����������ʾ��������� p3.8xlarge ʵ�������еġ��ýű��������

ʾ��GPU: 0, 1�������ʾ������ʹ�� 4 ������ GPU �е�ǰ��������Щ�ű�ͨ��ʹ�õ������㿪ͷ������

���ܼ�����ͷ�� GPU ������

GPU: 0, 1

unit: 1000

Minibatch-size: 400

epoch: 20

epoch mainloss validationmainloss mainaccuracy validationmainaccuracy

elapsed_time

1 0.277561 0.114709 0.919933 0.9654

6.59261

2 0.0882352 0.0799204 0.973334 0.9752

8.25162

3 0.0520674 0.0697055 0.983967 0.9786

9.91661

4 0.0326329 0.0638036 0.989834 0.9805

11.5767

5 0.0272191 0.0671859 0.9917 0.9796

13.2341

6 0.0151008 0.0663898 0.9953 0.9813

14.9068

7 0.0137765 0.0664415 0.995434 0.982

16.5649

8 0.0116909 0.0737597 0.996 0.9801

18.2176

37���ѧϰ AMI ������Աָ��

�ֲ�ʽѵ��

9 0.00773858 0.0795216 0.997367 0.979

19.8797

10 0.00705076 0.0825639 0.997634 0.9785

21.5388

11 0.00773019 0.0858256 0.9978 0.9787

23.2003

12 0.0120371 0.0940225 0.996034 0.9776

24.8587

13 0.00906567 0.0753452 0.997033 0.9824

26.5167

14 0.00852253 0.082996 0.996967 0.9812

28.1777

15 0.00670928 0.102362 0.997867 0.9774

29.8308

16 0.00873565 0.0691577 0.996867 0.9832

31.498

17 0.00717177 0.094268 0.997767 0.9802

33.152

18 0.00585393 0.0778739 0.998267 0.9827

34.8268

19 0.00764773 0.107757 0.9975 0.9773

36.4819

20 0.00620508 0.0834309 0.998167 0.9834

38.1389

5. ������ѵ����������ʱ���鿴���� GPU �����ʻ�����á���������֤��Щ GPU ���ڻ״̬���鿴

���ǵĸ��ء�NVIDIA Ϊ���ṩ��һ�ֹ��ߣ���ʹ������ nvidia-smi ���иù��ߡ����ǣ���ֻ��Ϊ��

�ṩ�����ʵĿ��գ���ˣ����ù����� Linux ���� watch ���ʹ�ø��߲ο��ԡ�������� watch ��

nvidia-smi ���ʹ�ã��Ա���ʮ��֮һ���ʱ����ˢ�µ�ǰ GPU �����ʡ���ָ������ DLAMI ��

��һ���ն˻Ự��Ȼ�������������

(chainer_p36) :~ watch -n0.1 nvidia-smi

��������һ�����������½���������ʹ�� ctrl-c �رոù��ߣ����������ڵ�һ���ն˻Ự��������

��ʾ����ͬʱ���������С�

Every 0.1s: nvidia-smi Wed Feb 28 00:28:50 2018

Wed Feb 28 00:28:50 2018

+-----------------------------------------------------------------------------+

| NVIDIA-SMI 384.111 Driver Version: 384.111 |

|-------------------------------+----------------------+----------------------+

| GPU Name Persistence-M| Bus-Id Disp.A | Volatile Uncorr. ECC |

| Fan Temp Perf Pwr:UsageCap| Memory-Usage | GPU-Util Compute M. |

|===============================+======================+======================|

| 0 Tesla V100-SXM2... On | 00000000:00:1B.0 Off | 0 |

| NA 46C P0 56W 300W | 728MiB 16152MiB | 10% Default |

+-------------------------------+----------------------+----------------------+

| 1 Tesla V100-SXM2... On | 00000000:00:1C.0 Off | 0 |

| NA 44C P0 53W 300W | 696MiB 16152MiB | 4% Default |

+-------------------------------+----------------------+----------------------+

| 2 Tesla V100-SXM2... On | 00000000:00:1D.0 Off | 0 |

| NA 42C P0 38W 300W | 10MiB 16152MiB | 0% Default |

+-------------------------------+----------------------+----------------------+

| 3 Tesla V100-SXM2... On | 00000000:00:1E.0 Off | 0 |

| NA 46C P0 40W 300W | 10MiB 16152MiB | 0% Default |

+-------------------------------+----------------------+----------------------+

+-----------------------------------------------------------------------------+

| Processes: GPU Memory |

| GPU PID Type Process name Usage |

38���ѧϰ AMI ������Աָ��

�ֲ�ʽѵ��

|=============================================================================|

| 0 54418 C python 718MiB |

| 1 54418 C python 686MiB |

+-----------------------------------------------------------------------------+

�ڱ�ʾ���У�GPU 0 �� GPU 1 ���ڻ״̬���� GPU 2 �� 3 �����ڻ״̬���������Բ鿴ÿ��

GPU ���ڴ������ʡ�

6. ��ѵ����ɺ������ĵ�һ���ն˻Ự������ʱ�䡣�ڱ�ʾ���У�����ʱ��Ϊ 38.1389 �롣

ʹ�� Chainer �ڵ��� GPU ��ѵ��

��ʾ����������ڵ��� GPU ��ѵ���������ֻ��һ�� GPU ���û���ֻ�����˽�� GPU ѵ���������

Chainer ������չ�������ִ�д˲�����

ʹ�� Chainer �ڵ��� GPU ��ѵ��

�ڱ�ʾ���У���ʹ����һ���ű� train_mnist.py����ָʾ����ʹ�ô� --gpu=0 ������ GPU 0��Ҫ

�鿴��ͬ�� GPU ����� nvidia-smi ����̨�м��������ͨ��ʹ�� --gpu=1 ��ָʾ�ű�ʹ�� GPU

��� 1��

(chainer_p36) :~srcchainerexamplesmnist python train_mnist.py --gpu=0

GPU: 0

unit: 1000

Minibatch-size: 100

epoch: 20

epoch mainloss validationmainloss mainaccuracy validationmainaccuracy

elapsed_time

1 0.192348 0.0909235 0.940934 0.9719

5.3861

2 0.0746767 0.069854 0.976566 0.9785

8.97146

3 0.0477152 0.0780836 0.984982 0.976

12.5596

4 0.0347092 0.0701098 0.988498 0.9783

16.1577

5 0.0263807 0.08851 0.991515 0.9793

19.7939

6 0.0253418 0.0945821 0.991599 0.9761

23.4643

7 0.0209954 0.0683193 0.993398 0.981

27.0317

8 0.0179036 0.080285 0.994149 0.9819

30.6325

9 0.0183184 0.0690474 0.994198 0.9823

34.2469

10 0.0127616 0.0776328 0.996165 0.9814

37.8693

11 0.0145421 0.0970157 0.995365 0.9801

41.4629

12 0.0129053 0.0922671 0.995899 0.981

45.0233

13 0.0135988 0.0717195 0.995749 0.9857

48.6271

14 0.00898215 0.0840777 0.997216 0.9839

52.2269

15 0.0103909 0.123506 0.996832 0.9771

55.8667

39���ѧϰ AMI ������Աָ��

�ֲ�ʽѵ��

16 0.012099 0.0826434 0.996616 0.9847

59.5001

17 0.0066183 0.101969 0.997999 0.9826

63.1294

18 0.00989864 0.0877713 0.997116 0.9829

66.7449

19 0.0101816 0.0972672 0.99 ......

������Աָ�����ѧϰ AMI ������Աָ��

���ѧϰ AMI: ������Աָ�� Copyright ? 2019 Amazon Web Services, Inc. andor its affiliates. All rights reserved.

Amazon's trademarks and trade dress may not be used in connection with any product or service that is not Amazon's,in any manner that is likely to cause confusion among customers, or in any manner that disparages or discredits

Amazon. All other trademarks not owned by Amazon are the property of their respective owners, who may or may not

be affiliated with, connected to, or sponsored by Amazon.���ѧϰ AMI ������Աָ��

AWS Deep Learning AMI��ʲô�� ........................................................................................................ 1

���ڱ�ָ�� ................................................................................................................................ 1

�Ⱦ����� .................................................................................................................................... 1

���� .......................................................................................................................................... 1

���� .......................................................................................................................................... 1

Ԥװ��� ............................................................................................................................ 1

Ԥװ GPU ���� .................................................................................................................. 2

ģ�ʹ����Ϳ��ӻ� ............................................................................................................... 2

���� .................................................................................................................................................. 3

��ο�ʼʹ�� DLAMI ................................................................................................................... 3

DLAMI ѡ�� ............................................................................................................................... 3

Conda ............................................................................................................................... 3

Base ................................................................................................................................. 4

CUDA ............................................................................................................................... 5

OS ................................................................................................................................... 6

ʵ��ѡ�� .................................................................................................................................... 6

GPU ................................................................................................................................. 7

CPU ................................................................................................................................. 7

���� .................................................................................................................................. 7

���� DLAMI ....................................................................................................................................... 9

���� 1������ DLAMI ................................................................................................................... 9

EC2 ����̨ ............................................................................................................................... 9

Marketplace ���� ...................................................................................................................... 10

���� 2�����ӵ� DLAMI .............................................................................................................. 10

���� 3������ DLAMI ʵ�� .......................................................................................................... 11