深度学习原理与TensorFlow实践.pdf

http://www.100md.com

2020年3月25日

|

| 第1页 |

|

| 第9页 |

|

| 第19页 |

|

| 第26页 |

|

| 第37页 |

参见附件(6948KB,304页)。

深度学习原理与TensorFlow实践是关于TensorFlow系统的书籍,主要讲述了TensorFlow开发机器的方法技巧和步骤,损失函数与优化算法等等相关的深度学习的内容。

内容简介

《深度学习原理与TensorFlow实践》主要介绍了深度学习的基础原理和TensorFlow系统基本使用方法。TensorFlow是目前机器学习、深度学习领域最优秀的计算系统之一,《深度学习原理与TensorFlow实践》结合实例介绍了使用TensorFlow开发机器学习应用的详细方法和步骤。同时,《深度学习原理与TensorFlow实践》着重讲解了用于图像识别的卷积神经网络和用于自然语言处理的循环神经网络的理论知识及其TensorFlow实现方法,并结合实际场景和例子描述了深度学习技术的应用范围与效果。

《深度学习原理与TensorFlow实践》非常适合对机器学习、深度学习感兴趣的读者,或是对深度学习理论有所了解,希望尝试更多工程实践的读者,抑或是对工程产品有较多经验,希望学习深度学习理论的读者。

作者资料

喻俨,百纳信息(海豚浏览器)研发副总裁。2007年加入微软亚洲工程院,2011年加入百纳信息负责海外业务线,从0到1做过多个项目,现致力于AI和大数据产品的研究与应用。

莫瑜,先后任职于微软和海豚浏览器,从事搜索引擎、音乐检索/哼唱搜索、内容分发推荐算法和对话机器人技术研发。长期以来持续关注和实践大规模数据算法性能优化、搜索引擎、推荐系统和人工智能技术。

王琛,英国爱丁堡大学人工智能专业硕士,现为百纳信息技术有限公司人工智能方向负责人。早年参加过信息学奥林匹克竞赛获得河北省第一名、全国三等奖,并保送进入中山大学。大学期间,在ACM竞赛上也屡获佳绩。硕士毕业后就职于百度基础架构部,参与大数据平台研发工作,对大数据分析处理、分布式系统架构等方面都有比较深刻的理解。2014年加入百纳,负责多个项目的研发,自2016年起负责人工智能方向的探索。

胡振邦,拥有博士学位,百纳信息技术有限公司高级算法研究员,毕业于中国地质大学计算机学院地学信息工程专业。读博期间,参与了关于遥感卫星图像识别分析的863项目,并且是主要的研发人员。毕业以来,一直从事图像识别方面的算法研发工作,主要方向包括目标检测、图文检索、图像分类与验证等,在图像处理、计算机视觉等方面都有深厚的积累和经验。

高杰,是一位1980年出生于苏北的“爱学习、能折腾、有情怀”的大叔。毕业于扬州中学特招班,1998年入学华中科技大学机械系,兼修管理、会计,自学计算机,2003年考入南京大学软件学院,曾任德国西门子内部SAP咨询师,还在中银国际TMT投行、金山软件集团投资部任过职,2015年与合伙人联合创立了图灵科技集团,与华尔街顶尖交易团队一起致力于量化交易、算法模型和人工智能在金融领域的应用,目前这家公司管理着超过20亿元的资产,是细分市场的领先公司。

章节预览

1 深度学习简介

1.1深度学习介绍

1.2深度学习的趋势

1.3参考资料

2 TensorFlow系统介绍

2.1TensorFlow诞生的动机

2.2TensorFlow系统简介

2.3TensorFlow基础概念

2.3.1计算图

2.3.2Session会话

2.4系统架构

2.5源码结构

2.5.1后端执行引擎

2.5.2前端语言接口

2.6小结

2.7参考资料

3.1 环境准备

3.1.1Mac OS安装

3.1.2Linux GPU服务器安装

3.1.3常用Python库

3.2Titanic题目实战

3.2.1Kaggle平台介绍

3.2.2Titanic题目介绍

3.2.3数据读入及预处理

3.2.4构建计算图

3.2.5构建训练迭代过程

3.2.6执行训练

3.2.7存储和加载模型参数

3.2.8预测测试数据结果

3.3数据挖掘的技巧

3.3.1数据可视化

3.3.2特征工程

3.3.3多种算法模型

3.4TensorBoard可视化

3.4.1记录事件数据

3.4.2启动TensorBorad服务

3.5数据读取

3.5.1 数据文件格式

3.6SkFlow、TFLearn与

3.7小结

3.8参考资料

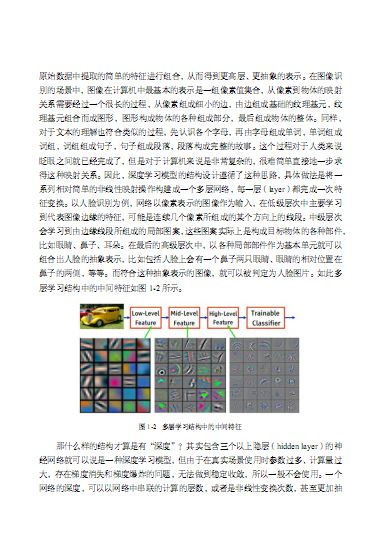

4 CNN“看懂”世界

4.1图像识别的难题

4.2CNNs的基本原理

4.2.1卷积的数学意义

4.2.2卷积滤波

4.2.3CNNs中的卷积层

4.2.4池化(Pooling)

4.2.6多层卷积

4.3经典CNN模型

4.3.3GoogLeNet &

4.4图像风格转换

4.4.1量化的风格

4.4.2 风格的滤镜

4.5 小结

4.6参考资料

5 RNN“能说会道”

5.1文本理解和文本生成问题

5.2标准RNN模型

5.2.1RNN模型介绍

5.2.2BPTT算法

5.2.3灵活的RNN结构

5.2.4TensorFlow实现正弦序列预测

5.3LSTM模型

5.3.1长期依赖的难题

5.3.2LSTM基本原理

5.3.3 TensorFlow构建LSTM模型

5.4更多RNN的变体

5.5语言模型

5.5.1NGram语言模型

5.5.2神经网络语言模型

5.5.3循环神经网络语言模型

5.5.4语言模型也能写代码

5.5.5改进方向

5.6对话机器人

5.6.1对话机器人的发展

5.6.2基于seq2seq的对话机器人

5.7小结

5.8参考资料

6 CNN LSTM看图说话

6.1CNN LSTM网络模型与图像检测问题

6.1.1OverFeat和Faster R-CNN图像检测算法介绍

6.1.2遮挡目标图像检测方法

6.1.3ReInspect算法实现及模块说明

6.1.4 ReInspect算法的实验数据与结论

6.2 CNN LSTM网络模型与图像摘要问题

6.2.1 图像摘要问题

6.2.2 NIC图像摘要生成算法

6.2.3 NIC图像摘要生成算法实现说明

6.2.4 NIC算法的实验数据与结论

6.3 小结

6.4 参考资料

7 损失函数与优化算法

7.1目标函数优化策略

7.1.1梯度下降算法

7.1.2RMSProp优化算法

7.1.3Adam优化算法

7.1.4目标函数优化算法小结

7.2类别采样(Candidate Sampling)损失函数

7.2.1softmax类别采样损失函数

7.2.2噪声对比估计类别采样损失函数

7.2.3负样本估计类别采样损失函数

7.2.4类别采样logistic损失函数

深度学习原理与TensorFlow实践截图

相关资料1:

- 重新认识学习.pdf

- A915L:医学免疫学学习指导与习题集-第3版-全书签.pdf

- Java机器学习.pdf

- 《我学习音乐的经过》冼星海.81130044_92.pdf

- A920L:眼科学学习指导与习题集-全书签.pdf

- HCNP路由交换学习指南.pdf

- 《重新认识学习》戴维森.pdf .epub

- 中心静脉穿刺学习班讲座幻灯.exe

- spring mvc学习指南 pdf高清电子版

- 高效学习魔法书.pdf

- 人体及动物生理学总复习题参考答案(20101212).pdf

- 《“毛泽东思想和中国特色社会主义理论体系概论”学习辅导》- 丁俊萍主编.2020.武汉大学出版社.pdf .epub

- 百会穴埋线疗法对血管性痴呆大鼠学习记忆及SOD、NO的影响.PDF

- 《第56号教室的奇迹:让孩子变成爱学习的天使》.(美)艾斯奎斯.扫描版.pdf

- 高绩效团队:打造强悍竞争力的学习型团队.pdf